先自我介绍一下,小编浙江大学毕业,去过华为、字节跳动等大厂,目前阿里P7

深知大多数程序员,想要提升技能,往往是自己摸索成长,但自己不成体系的自学效果低效又漫长,而且极易碰到天花板技术停滞不前!

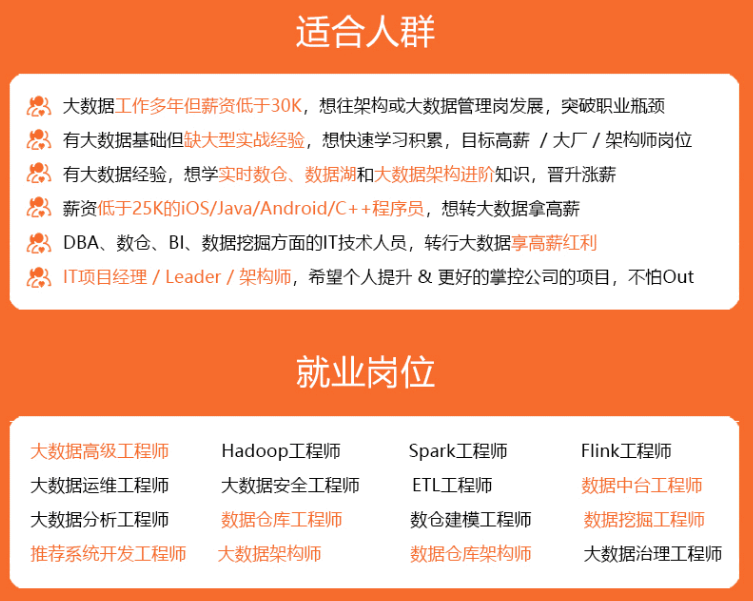

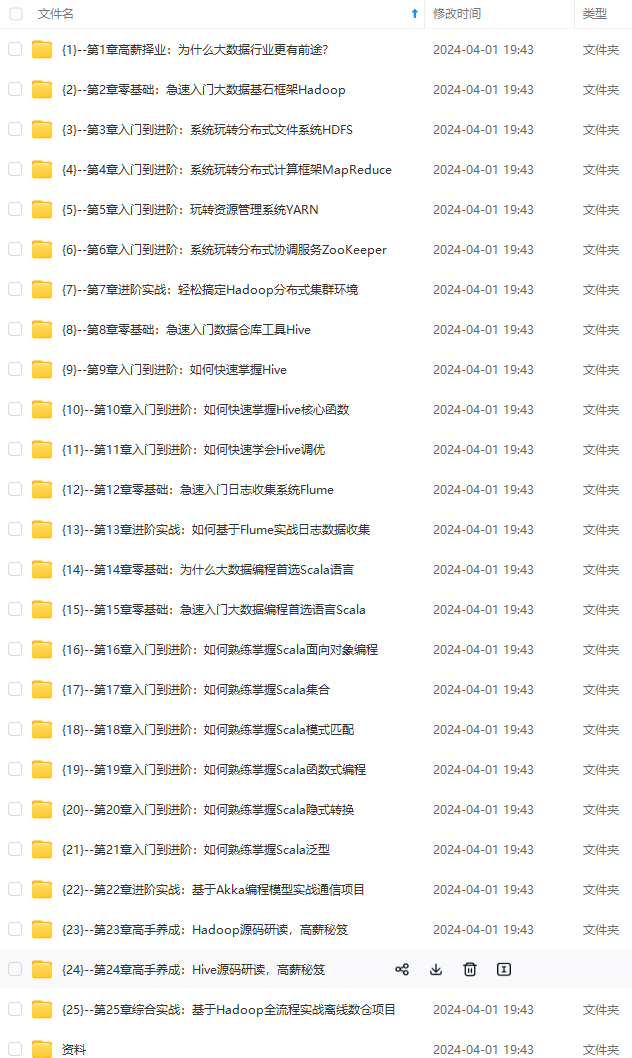

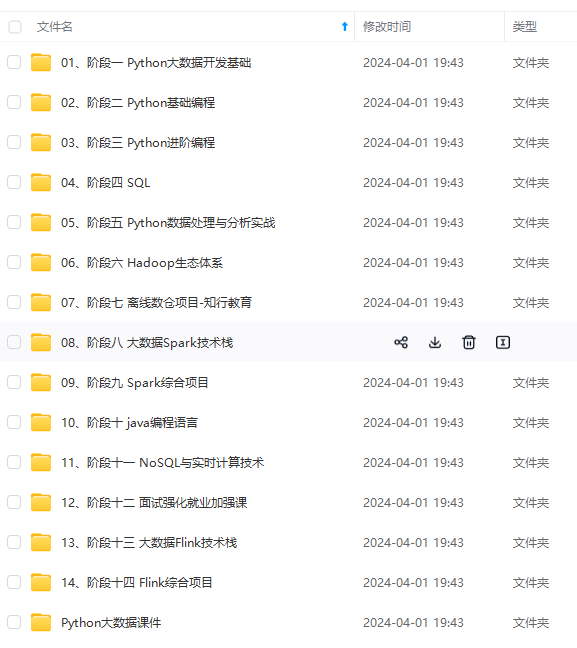

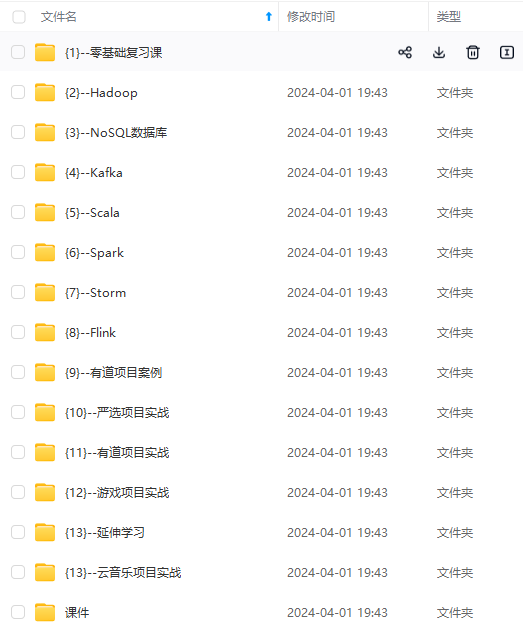

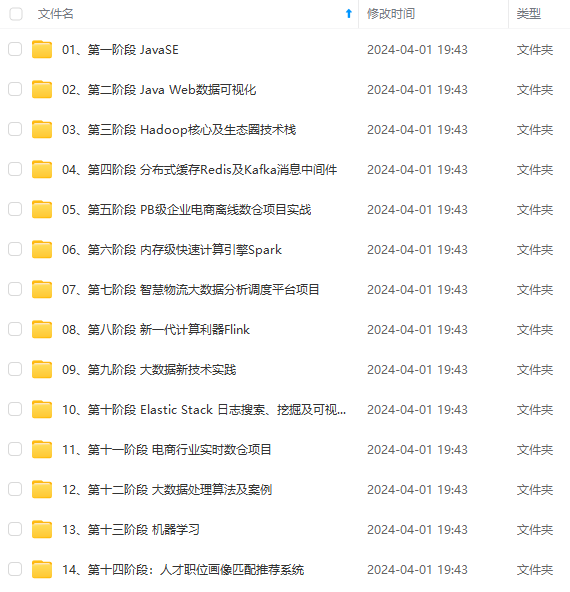

因此收集整理了一份《2024年最新大数据全套学习资料》,初衷也很简单,就是希望能够帮助到想自学提升又不知道该从何学起的朋友。

既有适合小白学习的零基础资料,也有适合3年以上经验的小伙伴深入学习提升的进阶课程,涵盖了95%以上大数据知识点,真正体系化!

由于文件比较多,这里只是将部分目录截图出来,全套包含大厂面经、学习笔记、源码讲义、实战项目、大纲路线、讲解视频,并且后续会持续更新

如果你需要这些资料,可以添加V获取:vip204888 (备注大数据)

正文

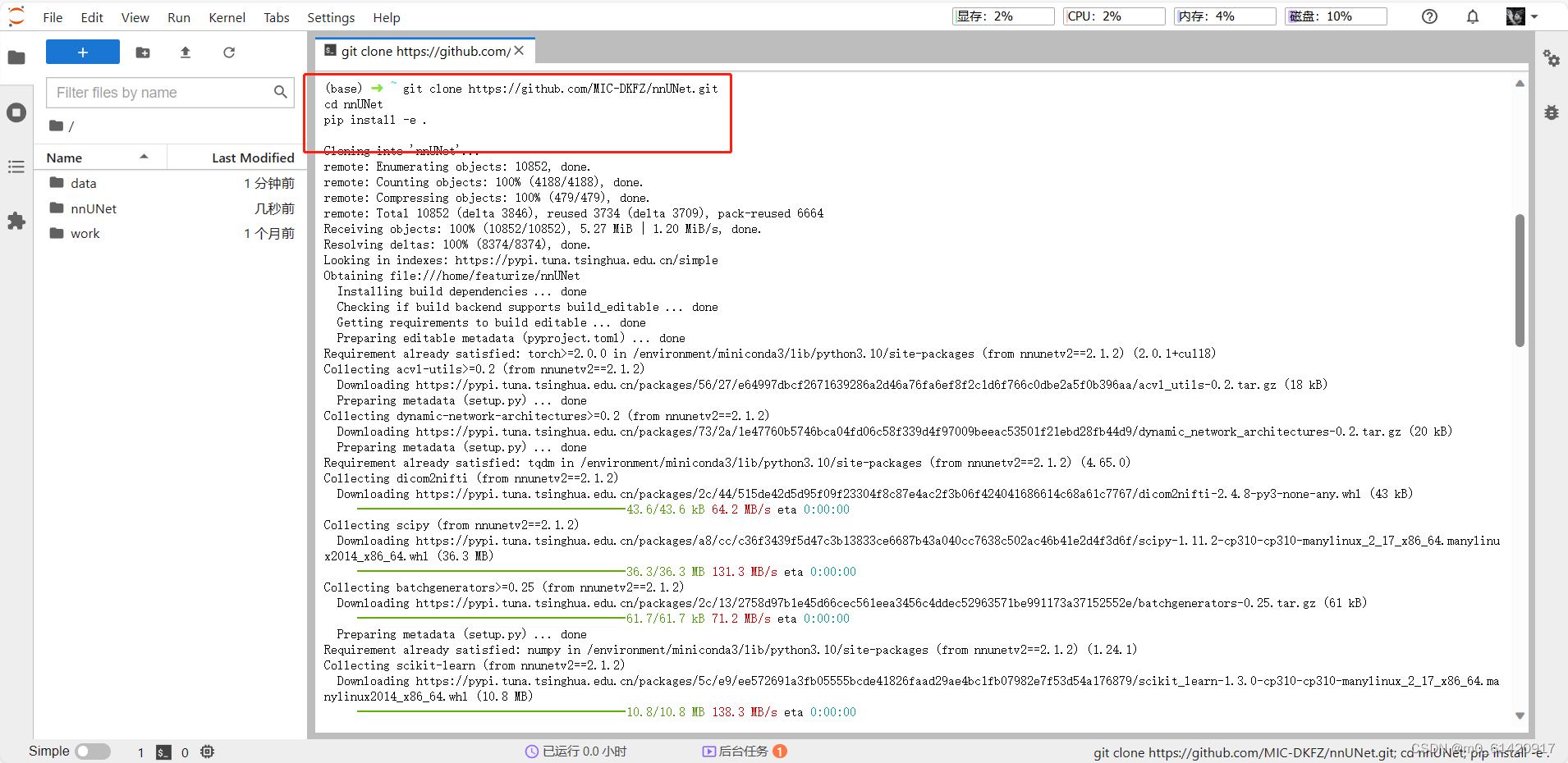

自己就会安装nnunetv2了!

一套流程后 pip list 里面有 nnunetv2 即完成(或者 pip show nnunetv2)

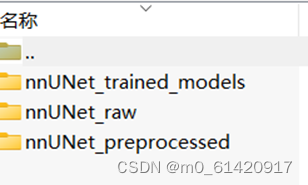

步骤四:开始配置文件结构(可以在本地提前准备好)

这部分还是和以前差不多

DATASET文件夹下方创建三个文件夹,分别为

| nnUNet_raw | 存放初始的影像和mask文件 |

| nnUNet_preprocessed | 预处理后的中间文件存放地 |

| nnUNet_trained_models | 训练完成的模型、训练过程存放地 |

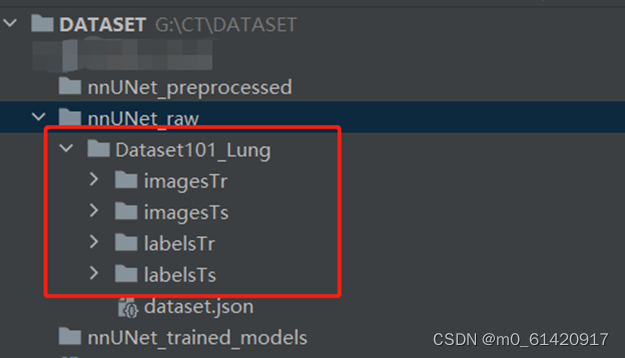

在nnUNet_raw文件夹下方在创立一个"DatsetXXX_NAME”

参考名:“Dataset101_Lung”

(数字编号是000-999的三位数字,最好大于200,因为比较小的数字已经被fabian的task id占用,以免在哪里莫名其妙冲突了)

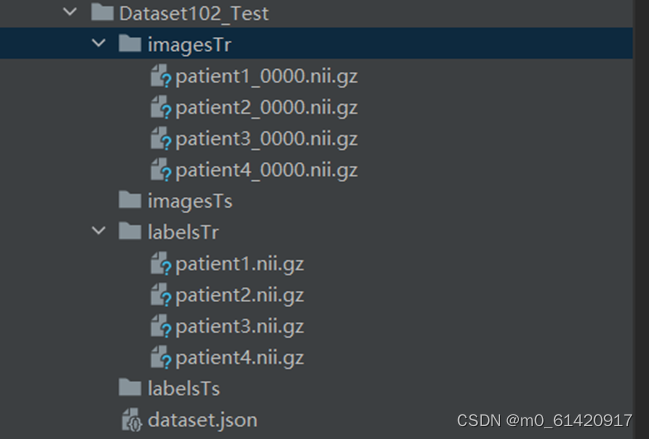

Dataset101_Lung下四个文件夹+一个json文件

| imagesTr | train训练集的医学影像(CT、MRI等) |

| imagesTs | test 检验集的医学影像(CT、MRI等)(optional) |

| labelsTr | train训练集的label涂层 |

| labelsTs | test 训练集的label涂层(optional) |

| dataset.json | 文件信息,详见步骤五 |

特别注意,取名原则如下:

images里面在.nii.gz前要加入0000(代表是模态0,若有其他模态的就依次0001,这个数字在json文件里要有体现,比如0模态是CT,1模态是MRI,详情请见步骤6),label是同名文件,但没有0000,0001

不同于nnunet初代版本在nnUNet_raw里面不需要额外的 cropped

步骤五:数据集的转换与json文件

数据集转化这次没用上,就先不细说了,后续再补充

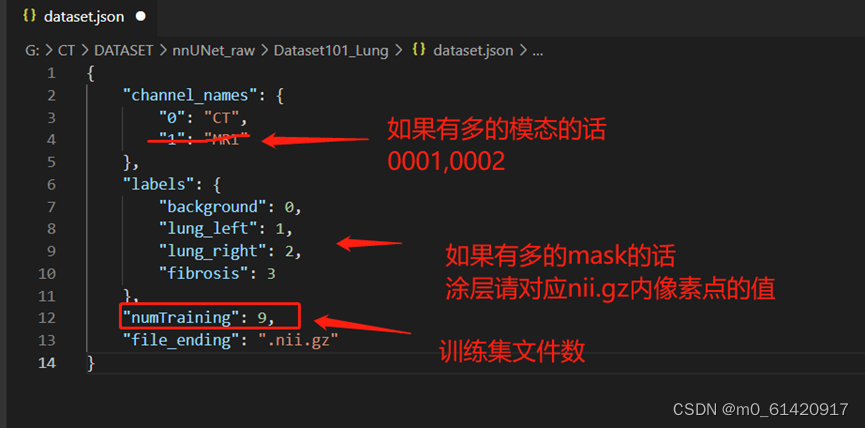

json文件相较nnunet初代版本改了好多。但考虑到其实写的比原先版本更简洁了,可以认为是件好事情吧:

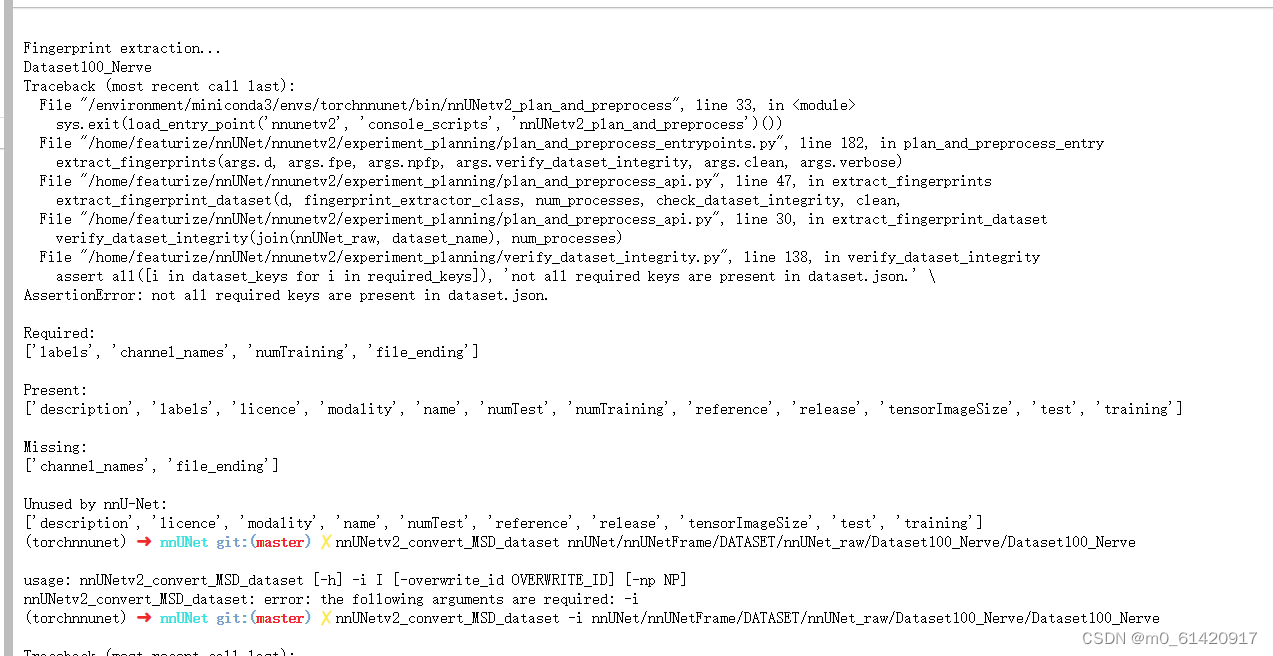

我一开始用了初代的json惨遭报错:

标准格式的文件如下:

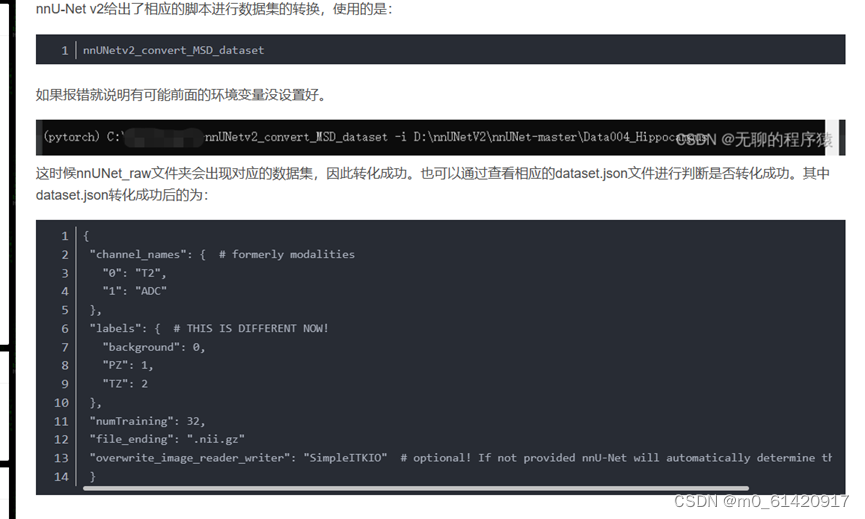

nnunetV2给了相应的脚本:

可参考:nnU-Net v2的环境配置到训练自己的数据集(详细步骤)_小萝北hh的博客-CSDN博客

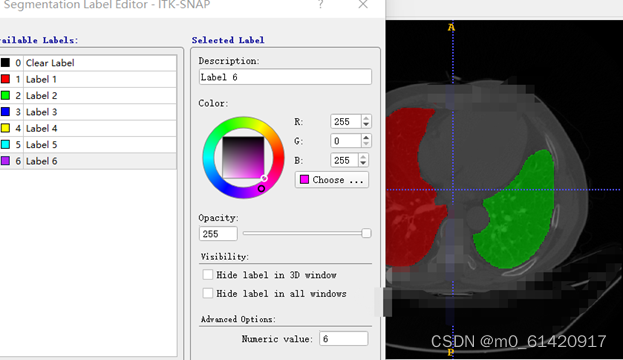

其中labels 0,1,2,3请务必对应好!所有mask文件上出现的数字都要有归属,目前nnunet尚不支持重合的mask(即不同mask之间有交集)。对文件里mask数字位置的,可以打开python去读文件或者,ITK-SNAP读一下:ITK-SNAP Home (itksnap.org)")

Label1是红色,label2是绿色,则这层mask的矩阵,对应红色区域位置是1,绿色的是2,其余(background)是0

(备注:ITK-SNAP,包括python里面一些需要调用itk包,都是在路径中不能出现中文字,甚至“-”都不能出现,可以改用为“_”)

步骤六:修改环境变量(三个)

这一步即为重要,在服务器上面无法ctrl+H的打开.bashrc文件,一般的本地也需要修改环境变量,用这个方法应该也可以

需要用到vim

1、进入vim

vim ~/.zshrc vim ~/.bashrc (在我的使用中是 vim ~/.zshrc

2、进入编辑模式

:a (注意冒号!)

3、修改三个环境变量:

请一一对应好步骤四 上述文件格式里的三个文件夹

(可以点到这个文件夹的位置,然后右键弹开,点击“复制绝对路径”)

export nnUNet_preprocessed="/home/featurize/nnUNet/nnUNetFrame/DATASET/nnUNet_preprocessed" export nnUNet_results="/home/featurize/nnUNet/nnUNetFrame/DATASET/nnUNet_trained_models" export nnUNet_raw="/home/featurize/nnUNet/nnUNetFrame/DATASET/nnUNet_raw" 4、退出编辑模式

按 Esc

5、退出 记得先按上一步的Esc

:wq 输入 :wq ( :不可忽略,保存退出)

输入 :q! (不保存退出)

6、退出后加载更新后的配置

source ~/.zshrc source ~/.bashrc (我的是source ~/zshrc)

7、更新后重新激活之前配置的环境

conda activate your_env_name

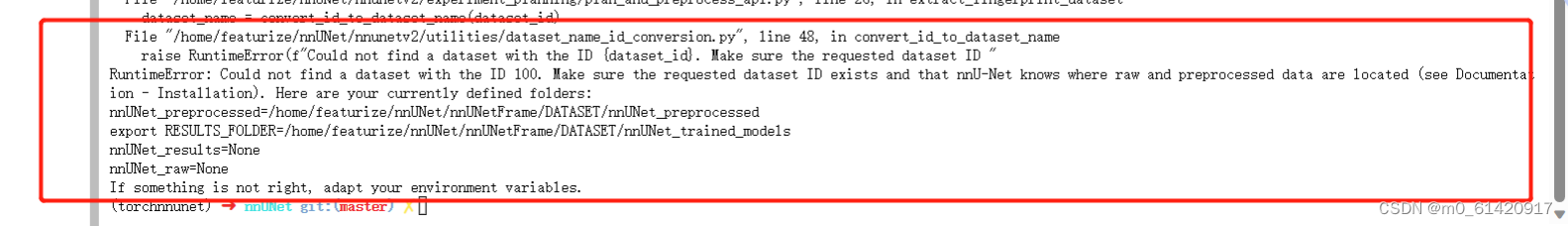

conda activate nnunet 常见问题: 这个就是典型环境变量没配好,报错写的很明显了,写明了nnUNet_result变量不存在

潜在的问题:

- 名字(可能在超算里面复制的路径前面还要加上 /home/xxxxx/)[一般来说,直接右键文件夹,然后复制绝对路径就没问题了]

- 文件结构是否有问题,特别是raw的路径要是DATASET01_NAME1的上一层

- 是否 source ~/.zshrc (否则相当于没刷新)

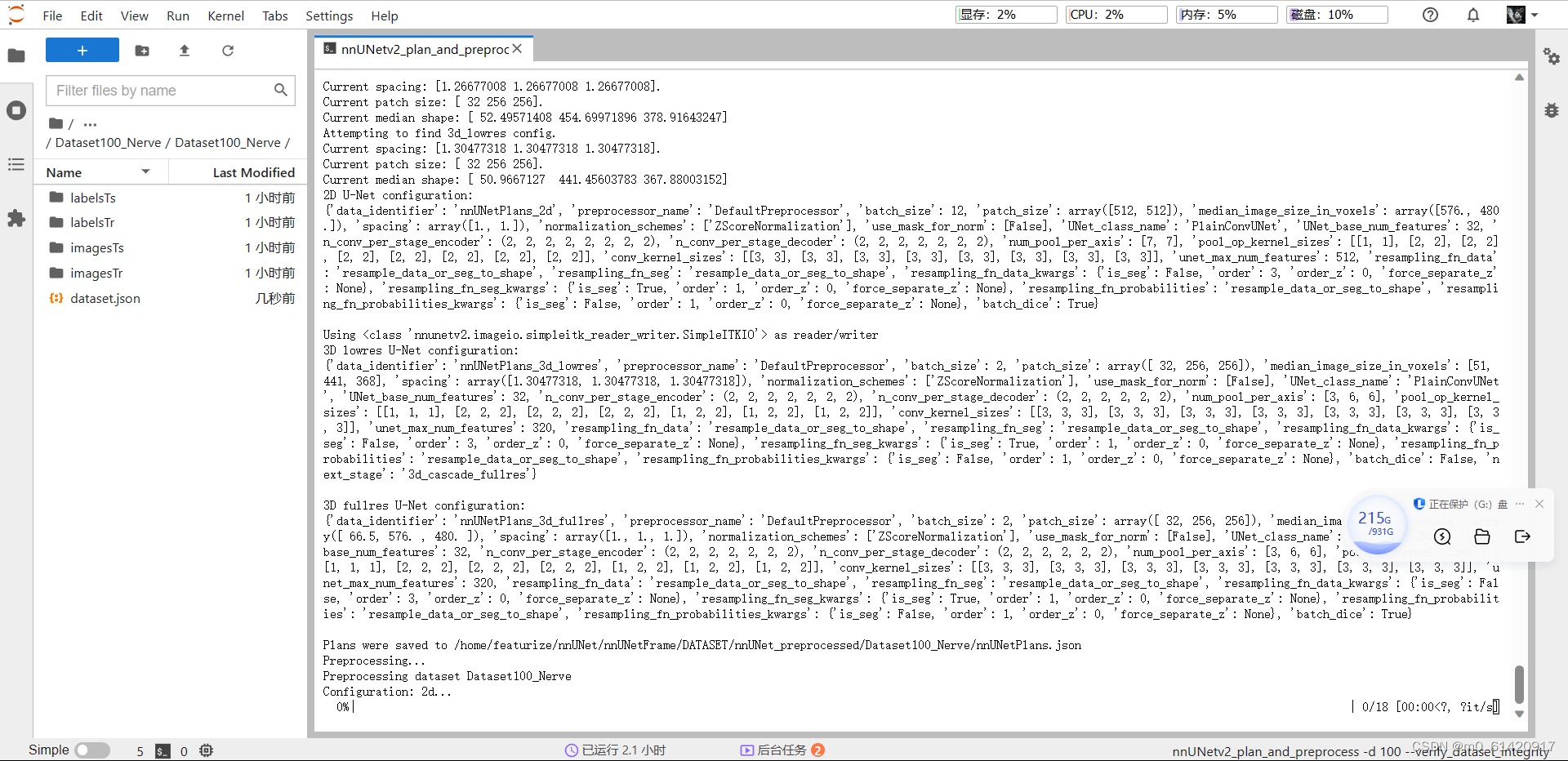

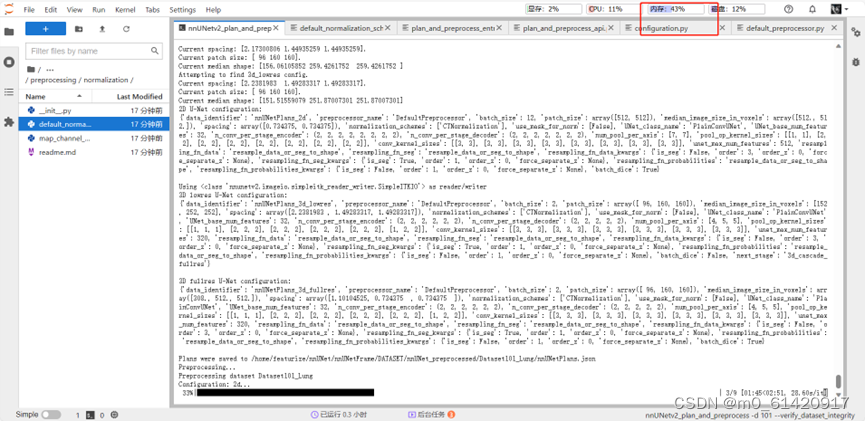

步骤七:数据集预处理

nnUNetv2_plan_and_preprocess -d TASK-NUM --verify_dataset_integrity

TASK-NUM是之前写的数字编号

nnUNetv2_plan_and_preprocess -d 101 --verify_dataset_integrity

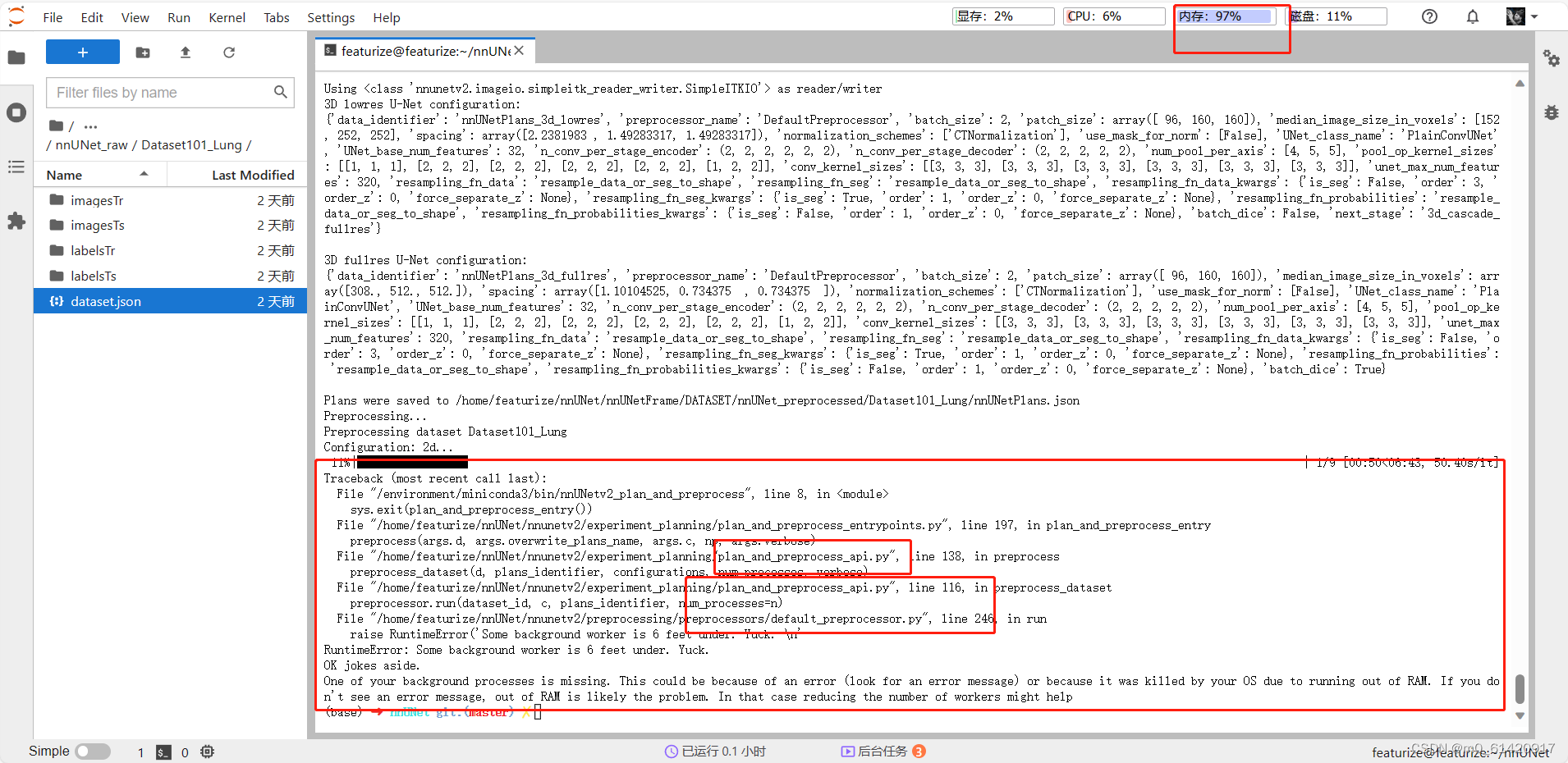

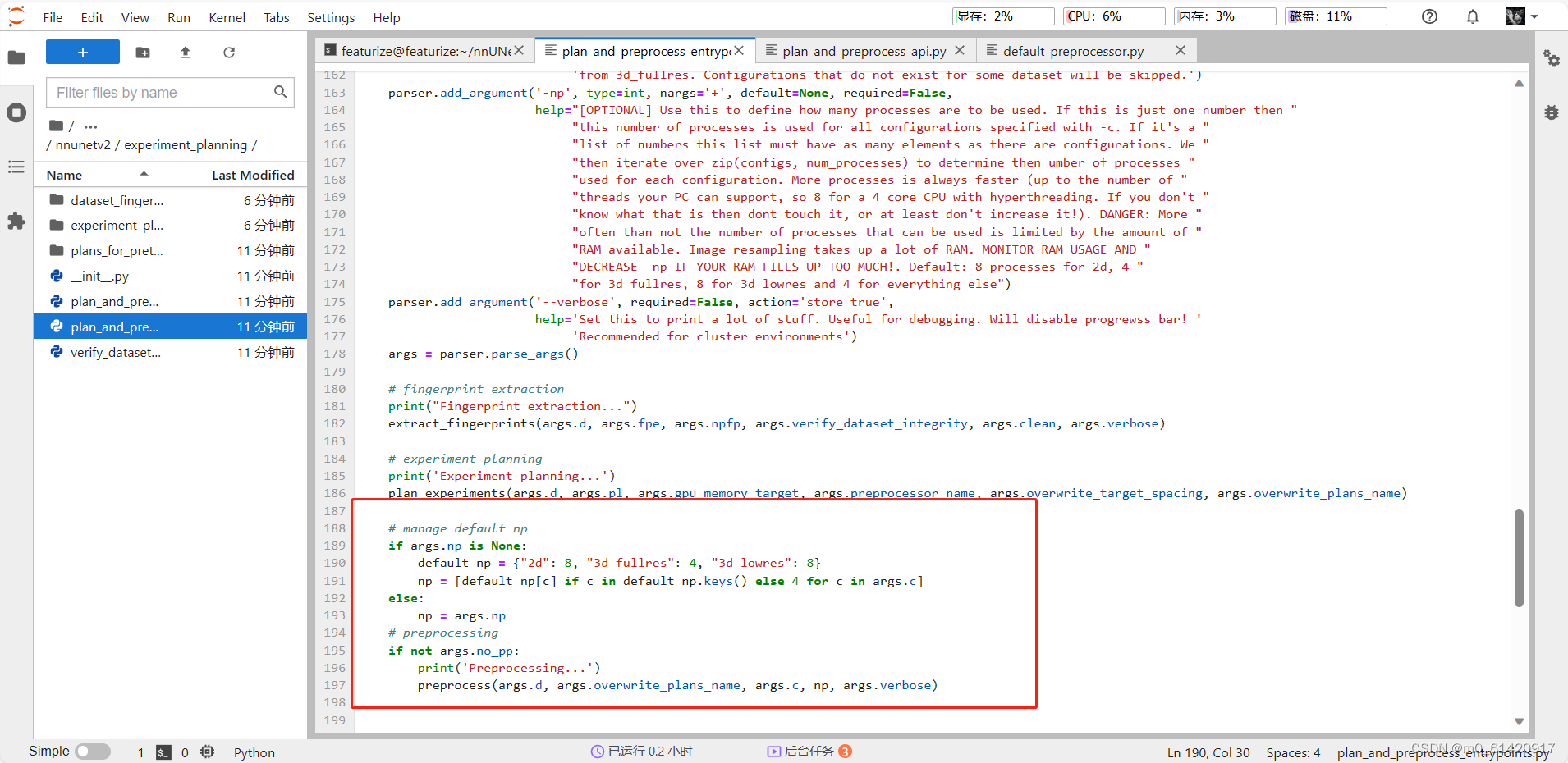

常见报错:RAM爆了,我当时在报错回溯一个一个去查,在plan_preprocess_entrypoints.py里找到了可以修改的地方

default_np = {“2d”:8, “3d_fullres”: 4, “3d_lowres”: 8} 改成了2,2,2(还不行就1,1,1;再不行就提升下换个配置吧。。。或者修改一下其他看上去能减少workers的地方)

减少这个np,能够让内存不会爆,但速度肯定会低,建议大家可以试试自己设备能够容纳的最大值

修改后内存就处于一个比较健康的状态了

修改后内存就处于一个比较健康的状态了

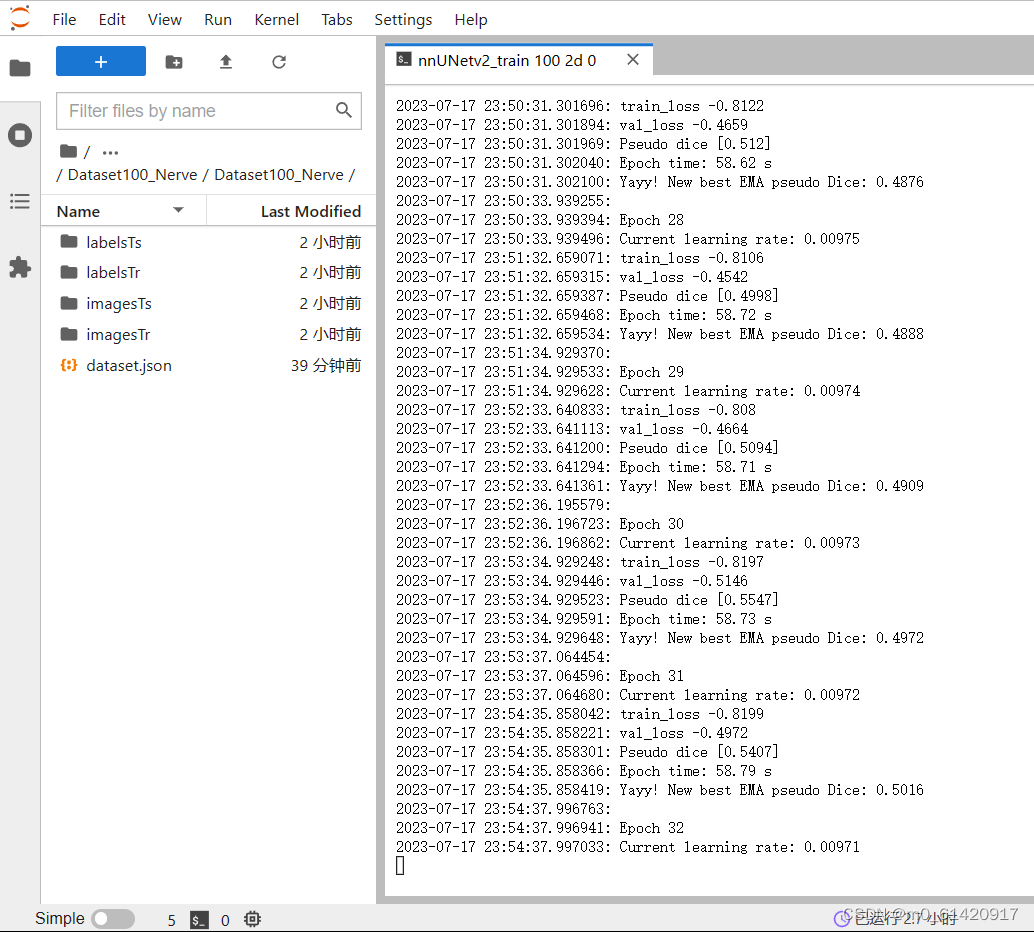

步骤八:模型训练

我贪方便,直接命令行里面写,跑完一折再写下一次。当然也可以编写终端运行此 tst.sh 文件,使用 source命令执行脚本(待补充学习)

nnUNetv2_train TASK-NUM 2d FOLD

nnUNetv2_train 101 2d 0 nnUNetv2_train 101 2d 1 nnUNetv2_train 101 2d 2 nnUNetv2_train 101 2d 3 nnUNetv2_train 101 2d 4 # 其中101表示数据集ID,上述提及过。0表示第1折

2d指的是训练Unet中的2d模型,可以选择3d_fullres,3d_lowres

开始训练了!Win!

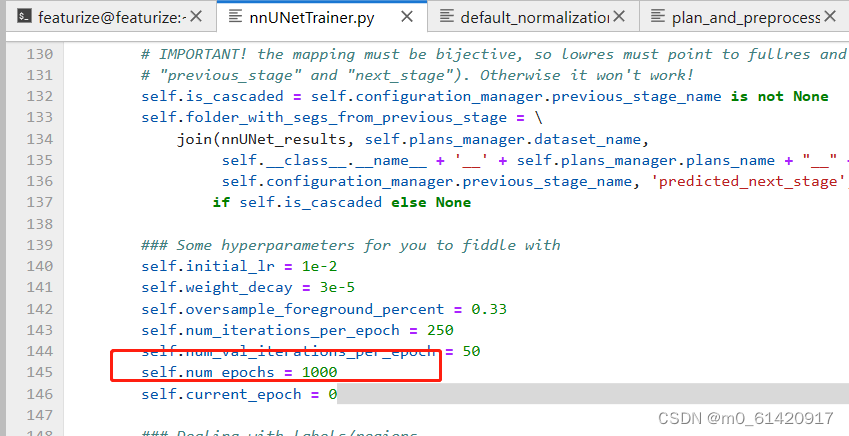

nnUNet/nnunetv2/training/nnUNetTrainer/nnUNetTrainer.py路径下可以修改一些参数:

比如把epochs改为自己想要的数字,特别是刚开始拿到一个数据的时候,想先随便训练一下,节约时间跑个几十次就完全ok了

比如把epochs改为自己想要的数字,特别是刚开始拿到一个数据的时候,想先随便训练一下,节约时间跑个几十次就完全ok了

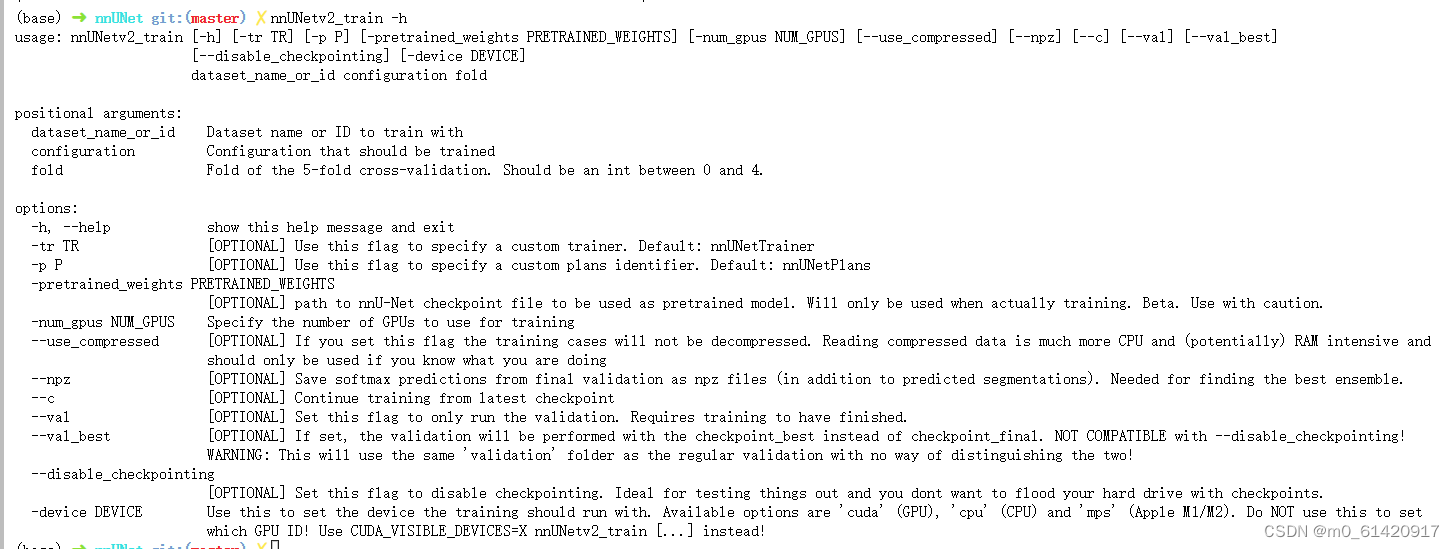

一些命令参数可以 在后面加上-h来查看

3. 在正常运行代码后遇到的问题:

Ctrl+C会中断实验,原来指令后面加--c可以接着运行,再也不担心跑了一整晚的东西白跑了!

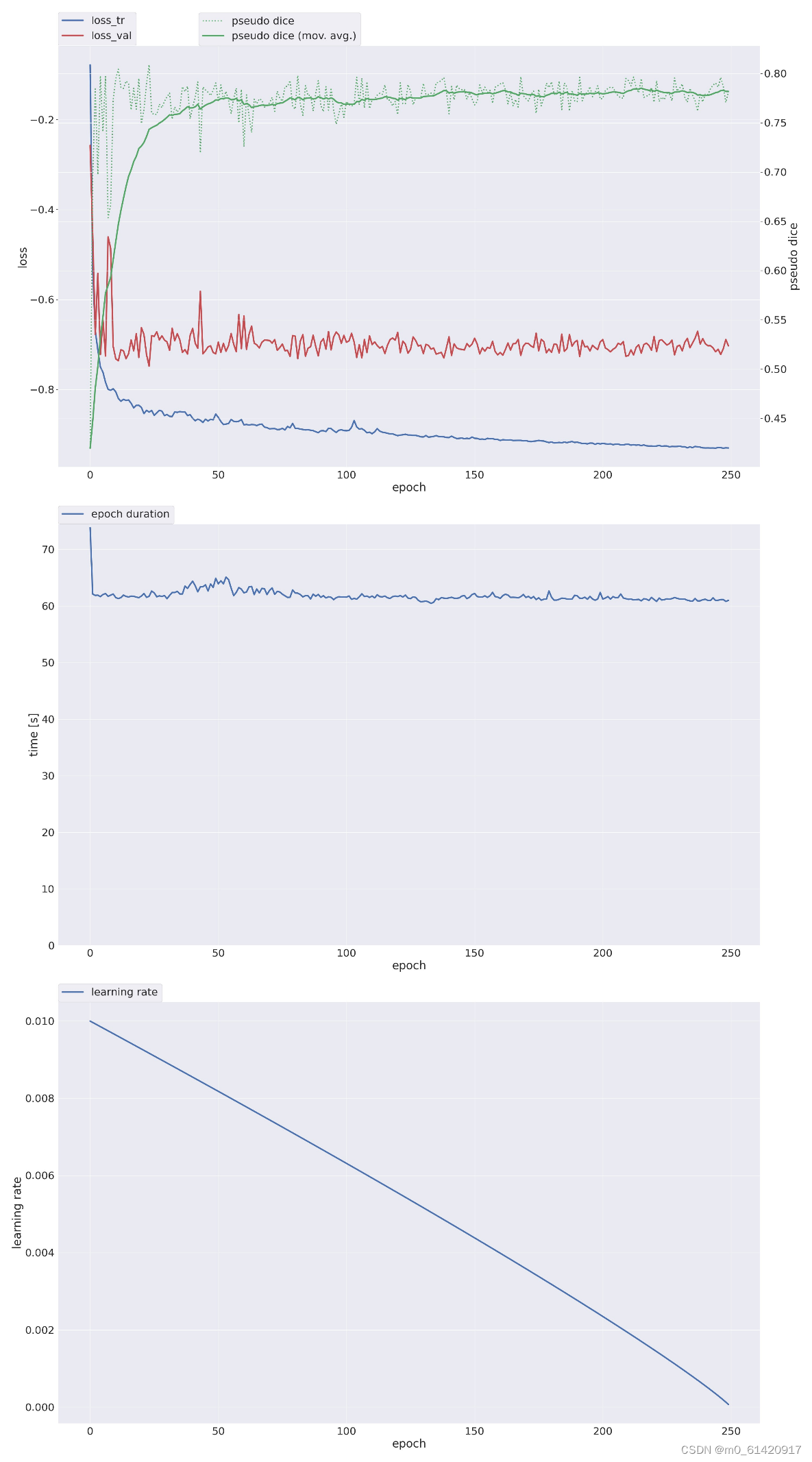

4.结果查看,每一折训练完都可以看看训练的过程:

比如progress.png就记录了训练迭代次数loss等的变化趋势,及时调整

位置在nnUNet/nnUNetFrame/DATASET/nnUNet_results/Dataset101_Lung/nnUNetTrainer__nnUNetPlans__2d/fold_0/progress.png

其中nnUNetTrainer__nnUNetPlans__2d中fold0,1,2,3,4下都能看到一些训练过程的记录

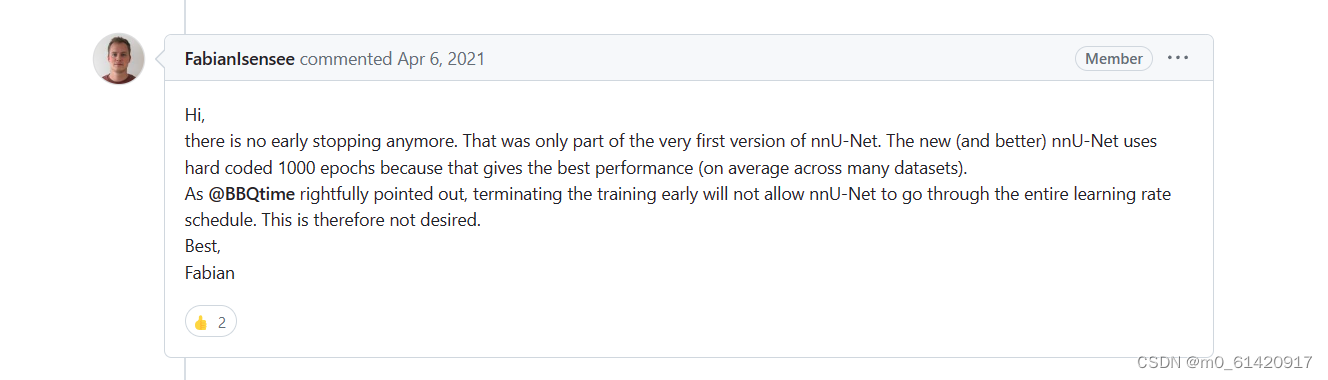

不同于一般的迭代过程,nnunet训练没有early stop概念,Fabian自己在github上解释了

步骤九:模型推理

可参考:

nnUNet实战一使用预训练nnUNet模型进行推理_nnunet 推理_Tina姐的博客-CSDN博客

nnUnet v2项目学习记录,训练自定义模型(不是Unet) - 知乎 (zhihu.com)")

精细化修改 修改loss等

↑参考,可用于提前推理

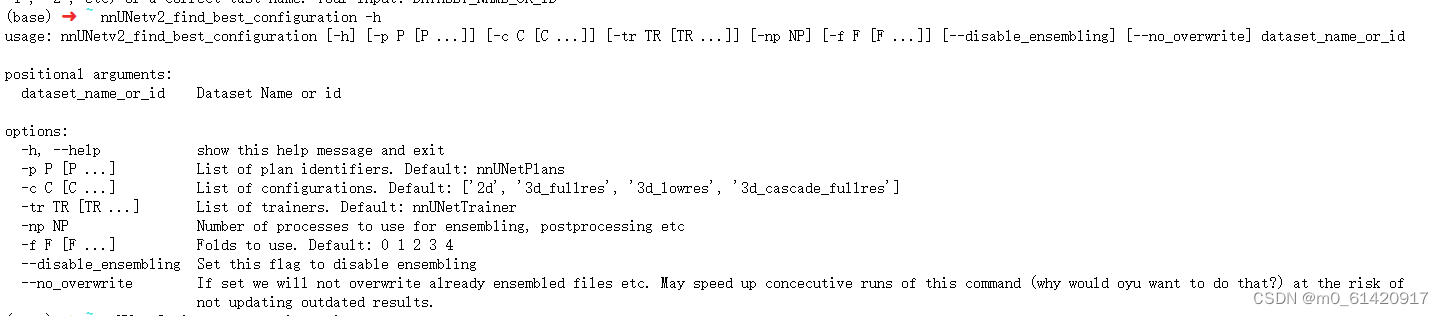

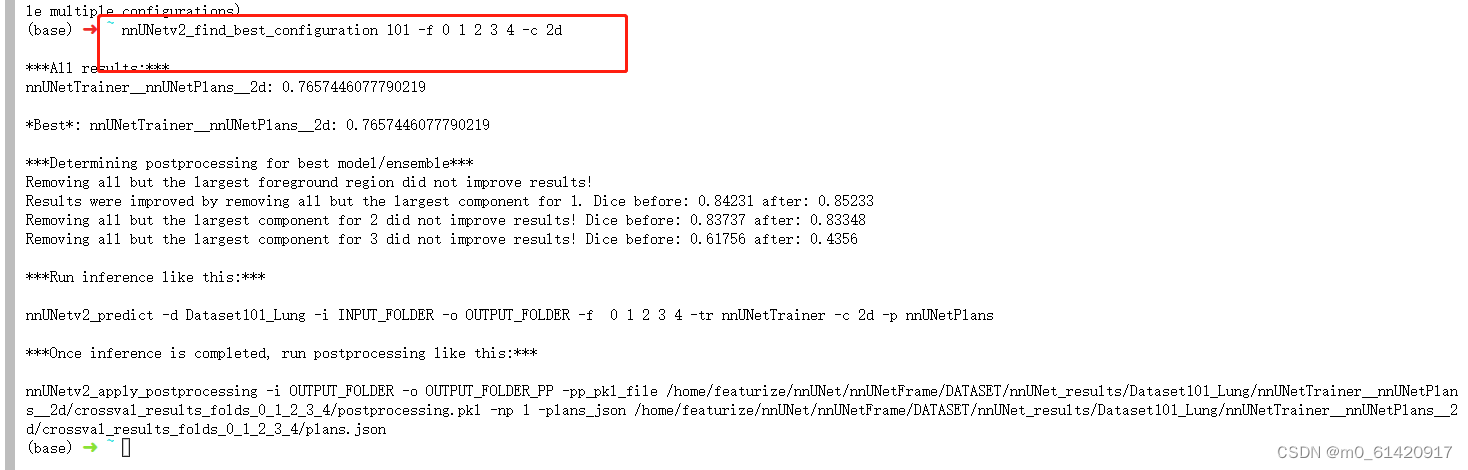

nnUNetv2_find_best_configuration 101 -f 0 1 2 3 4 -c 2d

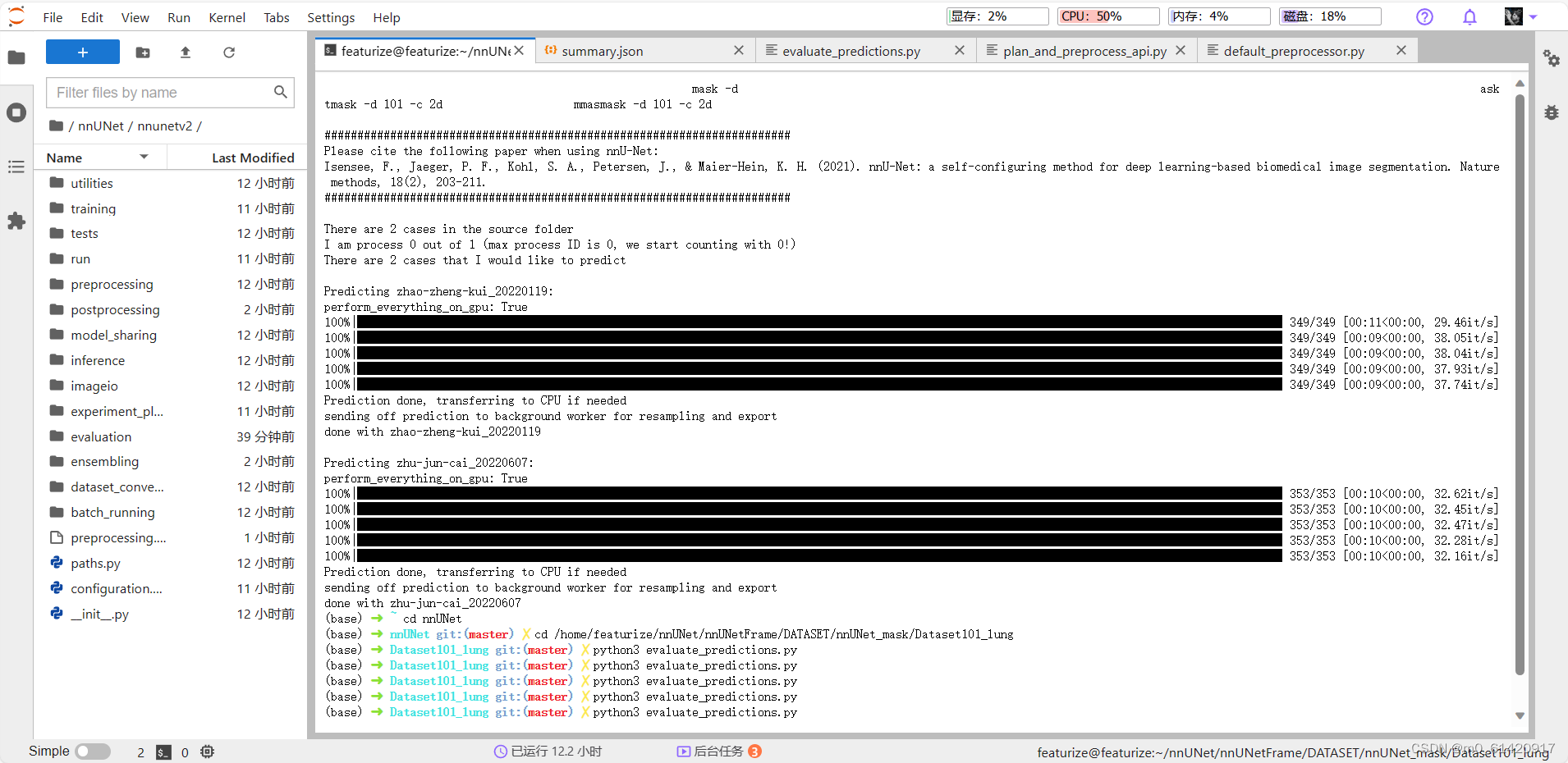

步骤十:模型预测

新建一个文件夹用于储存预测的mask文件

-I 后跟着是需要预测mask的原影像文件, -o后面跟着label储存的位置

nUNetv2_predict -i原影像文件夹 -o 储存位置 -d TASK-NUM -c 2d

nnUNetv2_predict -i nnUNet/nnUNetFrame/DATASET/nnUNet_raw/Dataset101_Lung/imagesTr -o /home/featurize/nnUNet/nnUNetFrame/DATASET/nnUNet_mask/Dataset101_lung/trainmask -d 101 -c 2d

步骤十一:预测结果分析

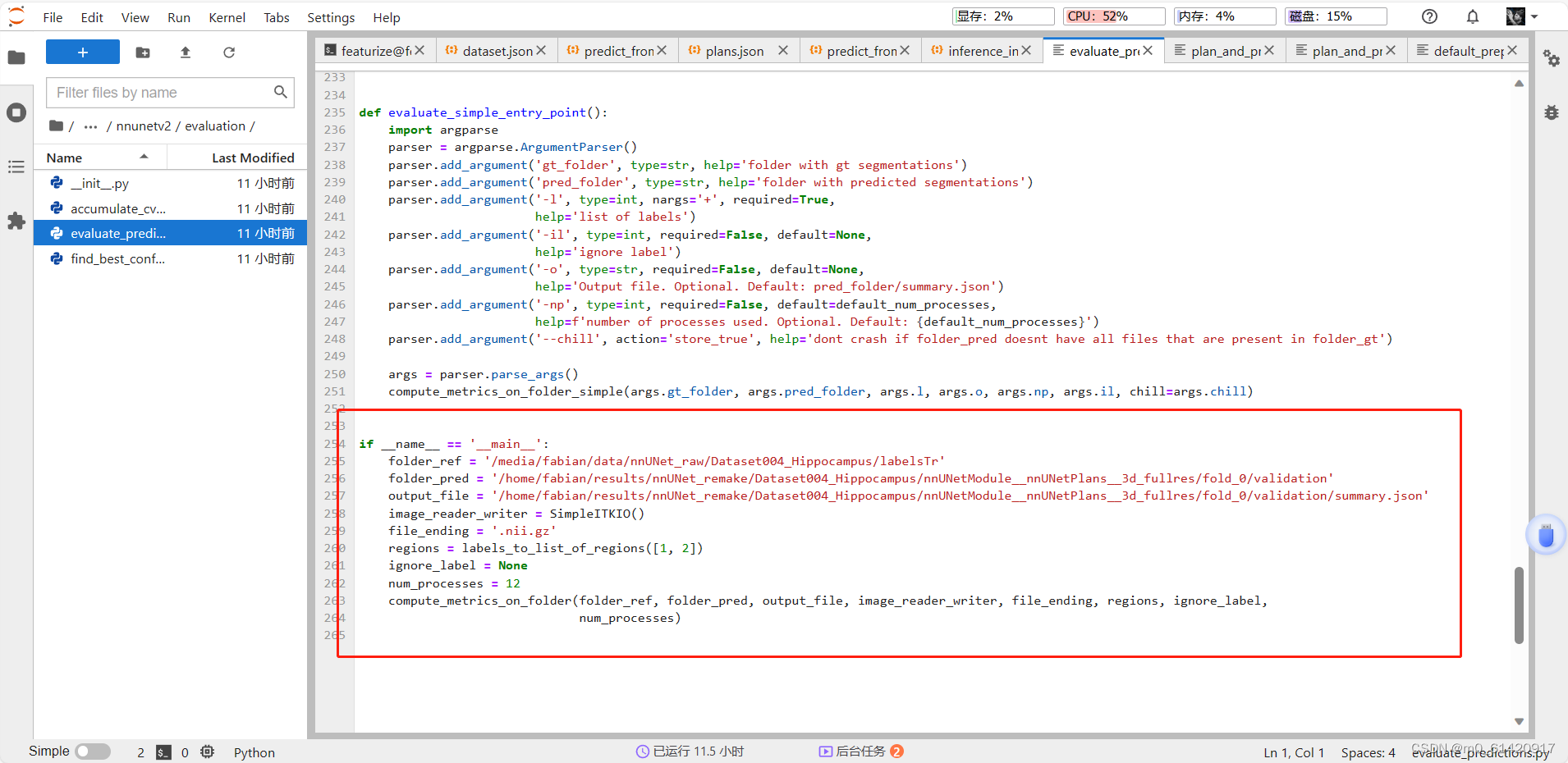

nnunet有自己内置的评价文件,位置在

预测结果分析:

/home/featurize/nnUNet/nnunetv2/evaluation/evaluate_predictions.py

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!

置的评价文件,位置在

预测结果分析:

/home/featurize/nnUNet/nnunetv2/evaluation/evaluate_predictions.py

网上学习资料一大堆,但如果学到的知识不成体系,遇到问题时只是浅尝辄止,不再深入研究,那么很难做到真正的技术提升。

需要这份系统化的资料的朋友,可以添加V获取:vip204888 (备注大数据)

[外链图片转存中…(img-oKhgiNyR-1713313660656)]

一个人可以走的很快,但一群人才能走的更远!不论你是正从事IT行业的老鸟或是对IT行业感兴趣的新人,都欢迎加入我们的的圈子(技术交流、学习资源、职场吐槽、大厂内推、面试辅导),让我们一起学习成长!