负载均衡:网络世界的交通指挥家

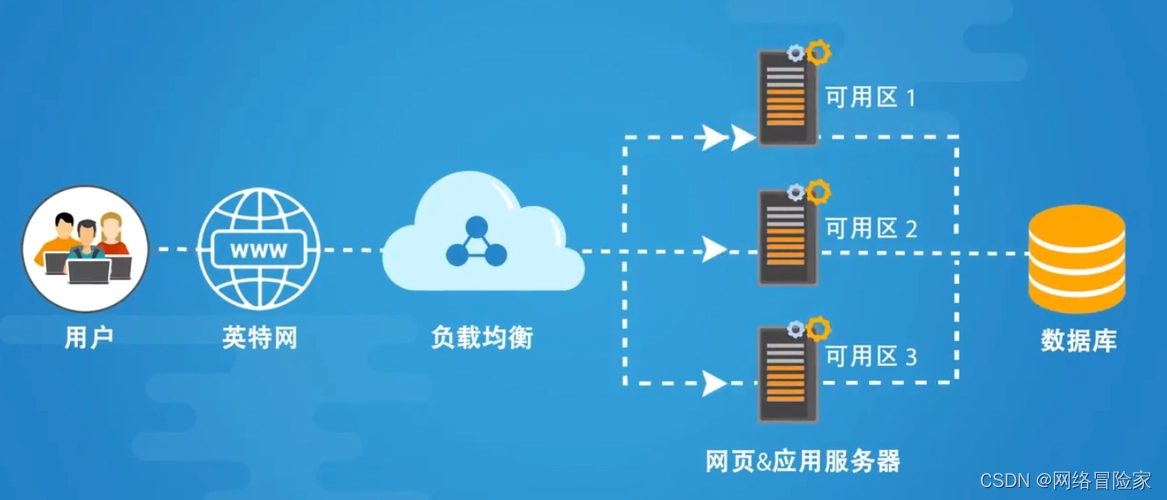

在当今的数字化时代,随着互联网应用的日益增多和用户数量的不断攀升,网络服务的稳定性和可靠性变得至关重要。负载均衡技术,作为确保网络服务高效、稳定运行的关键手段,扮演着网络世界的“交通指挥家”角色。本文将深入探讨负载均衡的概念、类型、工作机制以及其在现代网络架构中的重要性。

一、负载均衡的概念

负载均衡(Load Balancing)是一种分布式计算技术,旨在将网络流量和用户请求分散到多台服务器上,以此提高网络的吞吐量和响应速度,同时避免单点故障,增强系统的可用性和可靠性。

二、负载均衡的类型

负载均衡技术主要分为以下几类:

1. 硬件负载均衡

硬件负载均衡通过专门的硬件设备实现,通常部署在网络的关键节点上,如数据中心的入口处。它具有高性能、高稳定性的特点,但成本较高。

2. 软件负载均衡

软件负载均衡利用软件程序在服务器上实现,成本相对较低,灵活性更高,可以根据需要快速调整配置。

2.1几种常见的软件负载均衡解决方案:

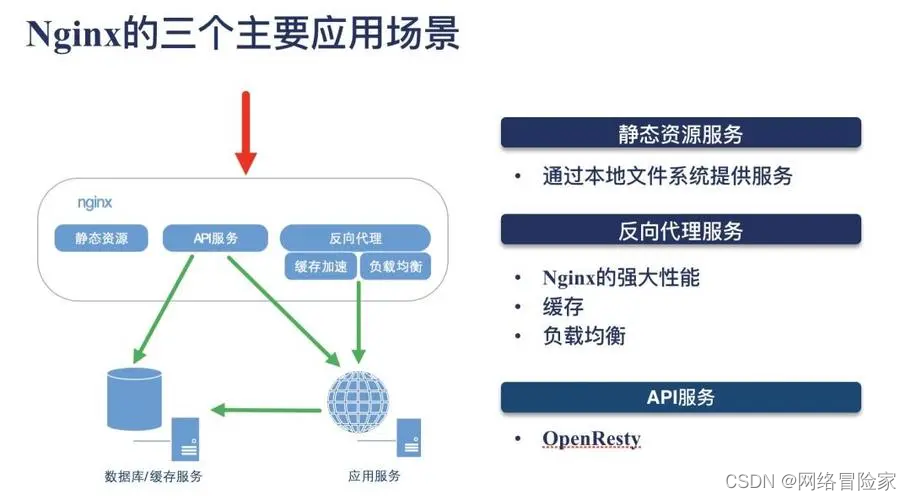

Nginx:一个高性能的HTTP服务器和反向代理,广泛用于负载均衡。Nginx工作在应用层(7层),能够针对HTTP应用做分流策略,如域名、目录结构等。Nginx安装和配置简单,具有灵活性和稳定性,适用于Web前端的负载均衡。

HAProxy:专为性能优化而设计的现代负载均衡器,支持TCP和HTTP协议的负载均衡转发,具备多种负载均衡策略,如动态加权轮询、源地址哈希等。HAProxy效率高,尤其在并发处理上表现优秀,适用于需要高性能负载均衡的场景。

LVS (Linux Virtual Server):一个开源的负载均衡软件,工作在网络层(4层),通过修改请求目标地址进行负载均衡。LVS具有高性能、高可用性和可扩展性,适用于大规模服务器集群。LVS对网络稳定性依赖较大,但因其抗负载能力强,常作为大型网站的负载均衡解决方案。

Keepalived:通常与LVS或Nginx结合使用,提供高可用性。Keepalived通过VRRP(Virtual Router Redundancy Protocol)实现故障转移,确保服务的连续性。

AWS Elastic Load Balancing (ELB):云服务提供商AWS的负载均衡服务,支持自动分配流量到多个目标,如EC2实例、容器服务等。

Google Cloud Load Balancing:Google Cloud提供的负载均衡服务,支持全球负载均衡,自动扩展以应对流量峰值。

3. 云负载均衡(Cloud Load Balancer,简称CLB)

随着云计算技术的发展,云负载均衡服务应运而生。它通过云服务提供商的基础设施,为用户的应用提供可扩展的负载均衡解决方案。

3.1 技术实现

不同云服务提供商可能提供不同的CLB产品,例如:

Amazon Web Services:提供Elastic Load Balancing(ELB),包括Application Load Balancer和Network Load Balancer等。

Microsoft Azure:提供Azure Load Balancer和Application Gateway。

Google Cloud Platform:提供Google Cloud Load Balancing。

阿里云、腾讯云等中国本地云服务商也提供类似的负载均衡服务。

3.2 阿里云CLB

阿里云的负载均衡(CLB)是一种流量分发控制服务,它通过虚拟服务地址将同一地域的多台云服务器虚拟成一个高性能和高可用的后端服务池,并根据转发规则,将来自客户端的请求分发给后端服务器池中的云服务器。CLB默认检查云服务器的健康状态,自动隔离异常状态的云服务器,消除了单点故障,提高了应用的整体服务能力。此外,CLB还具备抗DDoS攻击的能力,增强了应用服务的防护能力。

3.3 腾讯云CLB

腾讯云的负载均衡(CLB)是一种对多台云服务器进行流量分发的服务,它能够提升应用系统的访问流畅度,有效提升应用系统的容错能力,并具备自助管理、自故障修复和防网络攻击等高级功能。腾讯云CLB支持多种业务场景,如全局负载均衡、跨地域部署和混合云部署等,适用于企业、社区、电子商务、游戏等多种场景。CLB具备高性能特性,单集群的最大并发连接数超过亿级,能够处理最大40Gbps的流量带宽,同时具有高可用性和弹性扩展的能力。

三、负载均衡的工作机制

负载均衡器根据预定的算法和规则,将进入的网络请求分配给后端的服务器。常见的分配算法包括:

1. 轮询(Round Robin)

按顺序将请求轮流分配给服务器,适用于服务器性能相近的场景。

2. 最少连接(Least Connections)

将请求分配给当前连接数最少的服务器,适合处理不同类型的请求。

3. 随机分配(Random)

随机选择服务器来分配请求,简单易实现,但可能造成服务器负载不均。

4. 源地址哈希(Source IP Hash)

根据客户端IP地址进行哈希计算,将同一客户端的请求分配到同一台服务器,适用于需要会话保持的应用。

四、负载均衡的重要性

在现代网络架构中,负载均衡的作用不容小觑:

1. 提高性能

通过分散请求,负载均衡可以提升系统的整体处理能力,避免单个服务器过载。

2. 增强可靠性

当某台服务器出现故障时,负载均衡器可以自动将流量转移到其他服务器,保证服务不中断。

3. 优化资源利用

负载均衡可以根据服务器的实际负载进行动态调整,优化资源分配,提高效率。

4. 提升用户体验

快速响应和稳定的服务是提升用户体验的关键,负载均衡通过减少响应时间,提升用户满意度。

五、总结

负载均衡技术是现代网络服务不可或缺的一部分,它通过智能分配网络流量,确保了服务的高效、稳定和可靠。随着技术的不断进步,负载均衡将继续在网络世界中发挥其“交通指挥家”的作用,引领我们走向更加智能、高效的网络未来。

本文简要介绍了负载均衡的基本概念、类型、工作机制以及其在现代网络中的重要性。希望读者能够通过这篇文章,对负载均衡有更深入的了解和认识。

| 内容 | 地址 链接 |

|---|---|

| 软考 | 【第三版】系统集成项目管理工程 |

| Nginx | Linux (实战)常用命令 |

版本记录:

- 2024年4月20第一版