这是一个超详细安装教程,介绍了在 Window 电脑上如何部署 Qwen1.5 大模型。本文还涉及到 Python 及其环境的配置。

适合对象:有点后端编程基础,没有 Python 基础。

需要环境:Window10/11,支持 Cuda 的 Nvidia 显卡。

GPU升级到合适的驱动

- 先到[Nvidia官网下载]合适的驱动,例如我家里的电脑是GTX1060版本,选择如下:

- 点击搜索后会给出一些驱动选择,我选择了一个 537 的版本,配合我后续会提到的 cuda 12.2。

安装 Anaconda

搞机器学习的,Anaconda一般绕不开。

Anaconda 是一个用于科学计算的 Python 发行版,支持 Linux, Mac, Windows, 包含了众多流行的科学计算、数据分析的 Python 包。Conda是一个开源的包、环境管理器,可以用于在同一个机器上安装不同版本的软件包及其依赖,并能够在不同的环境之间切换。

因为我之前是学前端的,我给前端同学类比一下,每个环境就像 npm + package.json 组成的一个项目,还有可以指定该环境的 python 版本。这点在nodejs上只能通过 nvm 切换。

删除原有 Python

既然每个环境可以指定相应的 python 版本了,那我们就不用安装全局的 Python,先删除一下。

- 通过 控制面板 -> 卸载,找到 Python 卸载。

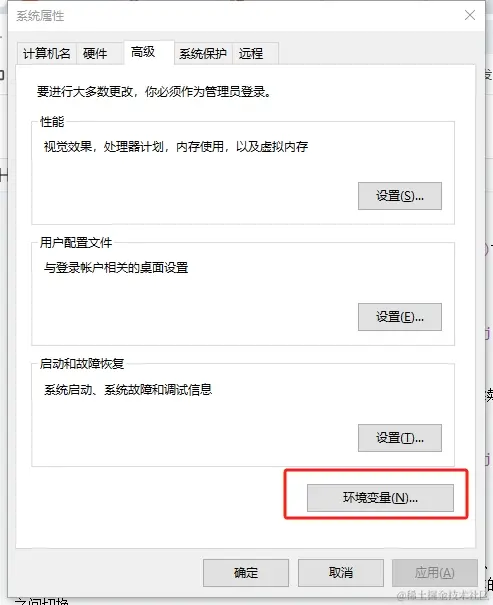

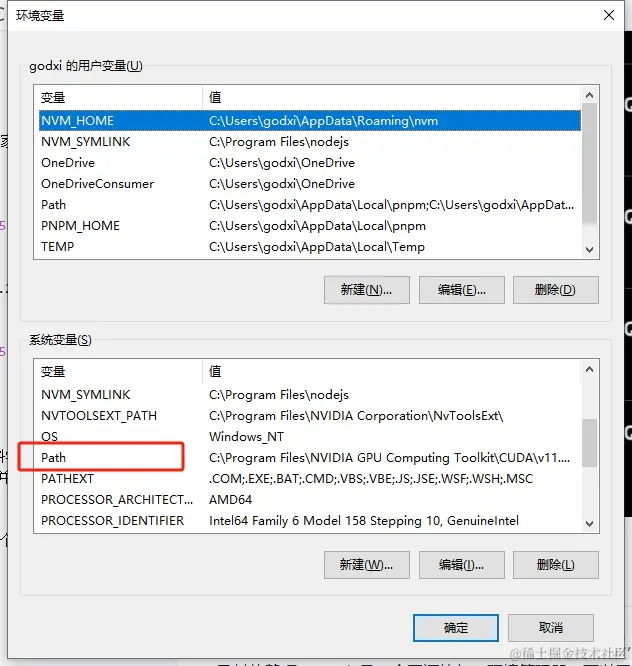

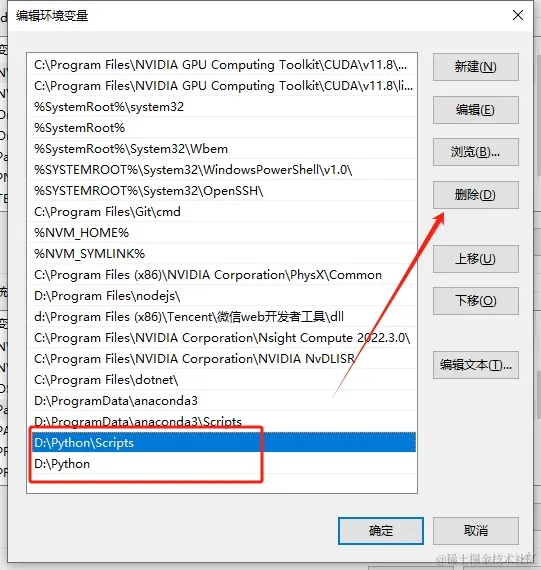

- 通过左下角搜索框搜 “环境变量” -> 编辑系统环境变量 -> 右下角 环境变量 -> 系统变量 -> Path

找到原来的 Python 安装的地址的两条记录,删掉。在退出时,记得点确定。

①人工智能/大模型学习路线

②AI产品经理入门指南

③大模型方向必读书籍PDF版

④超详细海量大模型实战项目

⑤LLM大模型系统学习教程

⑥640套-AI大模型报告合集

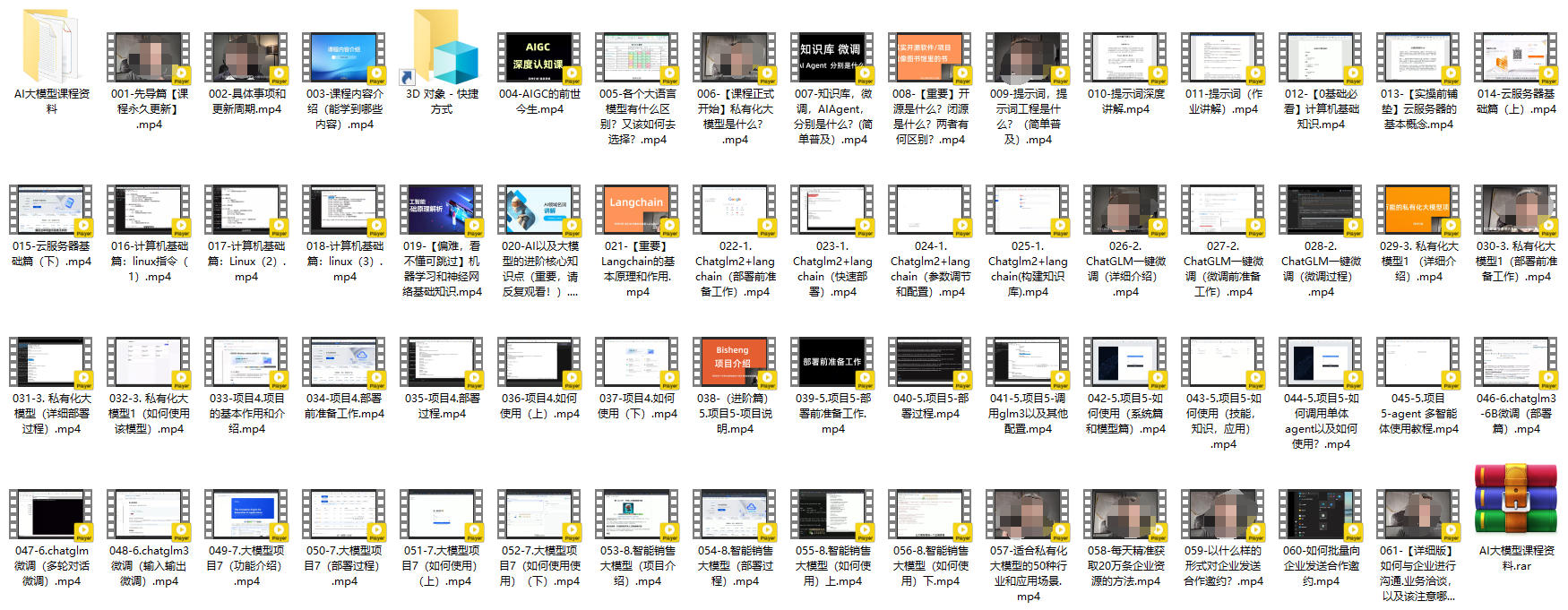

⑦从0-1入门大模型教程视频

⑧AGI大模型技术公开课名额

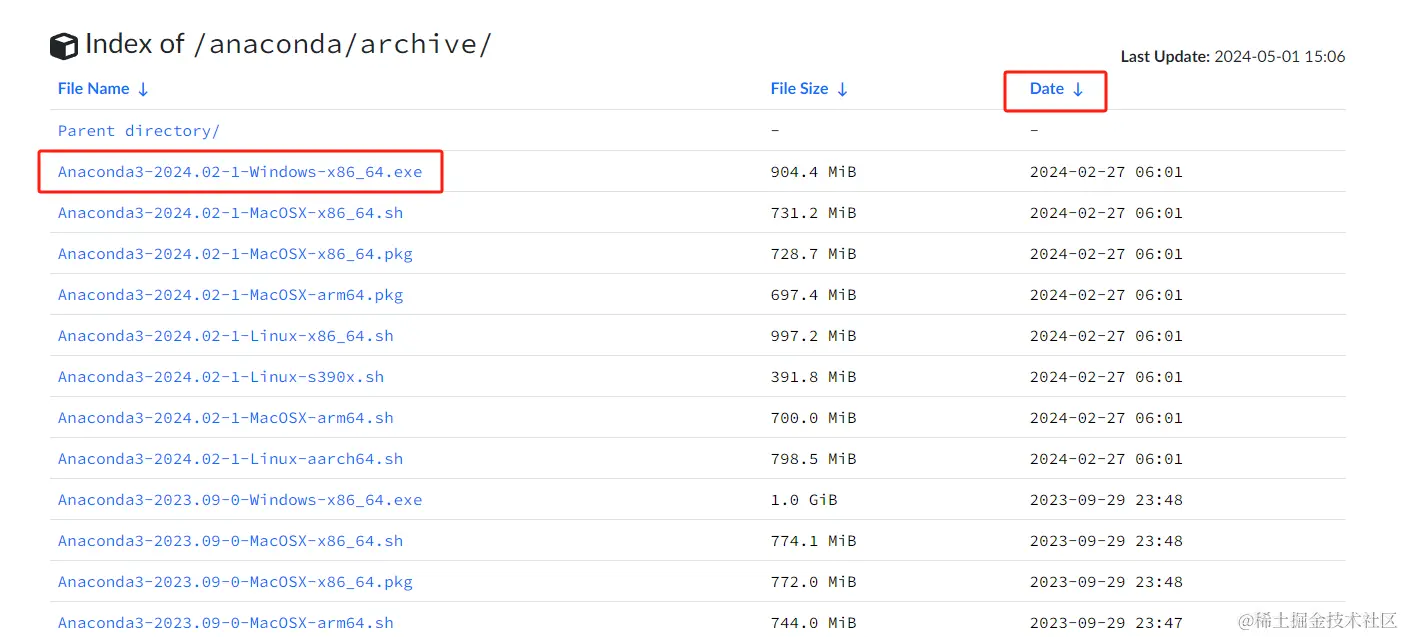

下载Anaconda3

首先来到Anaconda官网下载,算了,不推荐,下载起来有点麻烦。

我们来到清华的镜像站,点击安装包下载链接。这里有个注意点,记得点一下按时间倒排,才能看到最新的版本,选择符合我们的 Window 64位版本下载。

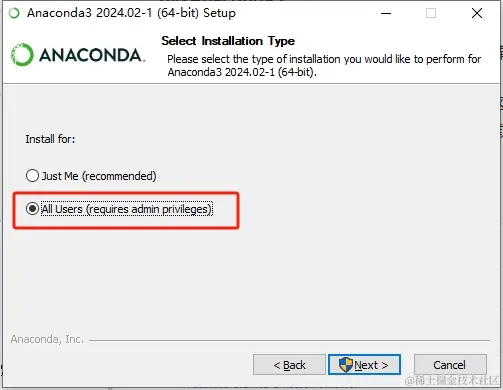

安装Anaconda3

安装过程有很多点击下一步,在这里省略。在这里针对C盘比较小的情况,选择安装盘的时候,需要选择 All Users 和改到其它盘。

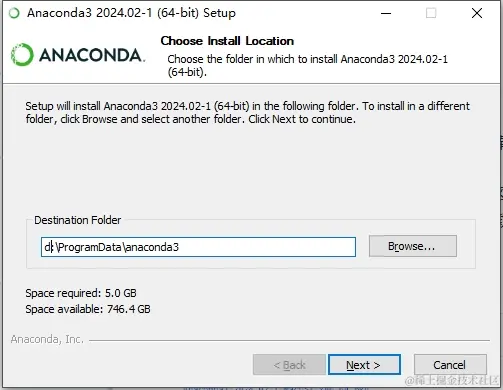

配置环境变量

我们继续回到刚才删掉 Python 环境变量的 Path 上,把Anaconda3的安装地址加进去。

检查安装成功与否

配置完环境变量,重启一下电脑。这是环境变量生效最不烧脑的做法。

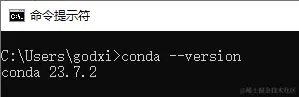

按 Win + R,输入 cmd 确定进入命令行提示框,输入:

conda --version

此时能看到 conda 的版本号。

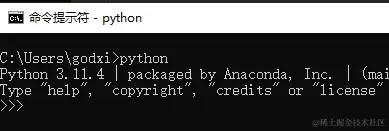

接入我们输入 python 进入python交互环境:

同样的,我们也能看到 Python 的版本号。

在这里我们可以通过 Ctrl+Z 再加 Enter 或者输入 exit() 来退出环境。

更换conda源

官方的源在国外,下载缓慢且不稳定。我们这里更换成国内的镜像。

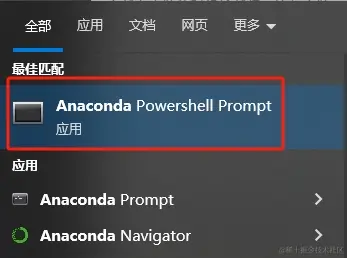

- 首先通过系统左下角搜索“Anaconda”,选择“Anaconda Powershell Prompt”点击进去。

执行以下命令生成 .condarc 文件:

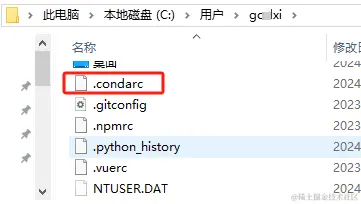

conda config --set show_channel_urls yes - 后在用户目录下找到

.condarc文件打开:

修改为以下内容:

channels: - defaults show_channel_urls: true default_channels: - https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/main - https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/r - https://mirrors.tuna.tsinghua.edu.cn/anaconda/pkgs/msys2 custom_channels: conda-forge: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud msys2: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud bioconda: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud menpo: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud pytorch: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud pytorch-lts: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud simpleitk: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud deepmodeling: https://mirrors.tuna.tsinghua.edu.cn/anaconda/cloud/ - 运行

conda clean -i清除索引缓存,保证用的是镜像站提供的索引。

注1:清华 Anaconda 镜像使用帮助,点击过去把地址收藏一下,后续有更新以他为准。

注2:后续如果想切换回官方源,.condarc 文件里面的内容清掉即可。

创建虚拟环境

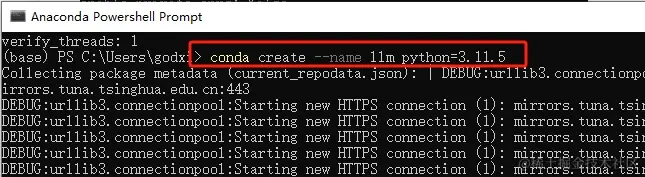

- 通过以下命令来创建虚拟环境:

> conda create --name <name> python=<version>

在这里我们创建的虚拟环境名称为 llm,选择 Python 的版本选择为 3.11.5。

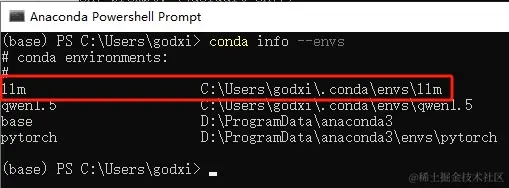

- 查看环境是否创建成功

通过命令:

conda info --envs

可以看到,我们创建的 llm 已经在里面了。

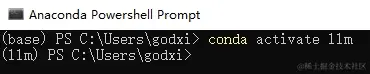

- 接下来我们切换到创建的环境中

conda activate <name>

部署大模型

下载大模型

以我们要部署的 Qwen1.5-0.5B-Chat 为例,通过 Modelscope社区 ,提供的下载方式,我们选择Git方式下载。

git clone https://www.modelscope.cn/qwen/Qwen1.5-0.5B-Chat.git 我把大模型下载到 D:\大模型\Qwen1.5-0.5B-Chat 目录下。

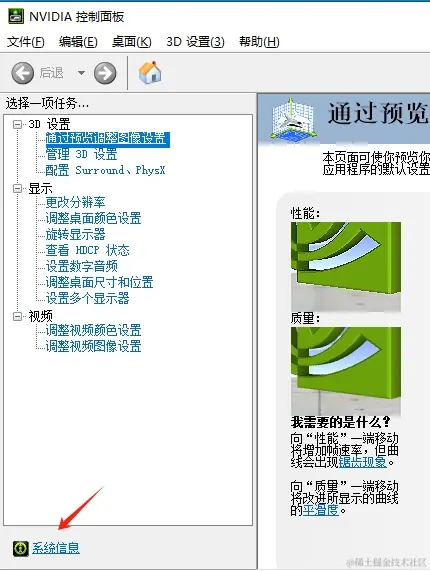

安装依赖

在这之前,我们先查一下我们的cuda版本。前面已经装好了相应的NVIDIA驱动,我们通过桌面右键,选择“NVIDIA控制面板”->左下角“系统信息”->切换为“组件”Tab:

可以看到我的cuda版本为12.2。

安装PyTorch

通过 PyTorch官网 找到相应的安装脚本。

这里选择 PyTorch 2.1.0 版本,之所以不选择更加新的版本,是因为会遇到其它问题。而cuda则选择12.1版本的,跟我电脑的12.2比较接近。

conda install pytorch==2.1.0 torchvision==0.16.0 torchaudio==2.1.0 pytorch-cuda=12.1 -c pytorch -c nvidia 安装transformers

这里提供一下 Qwen官方文档,我们需要安装transformers库:

conda install conda-forge::transformers 配置VSCode

在写代码前,先配置一下写代码工具,那是必须的。这里以 VSCode 为例。

- 下载安装

通过 官网地址 进行下载安装。

- 安装拓展

同时推荐安装 autoDocstring - Python Docstring Generator、autopep8。这样 VSCode 在编写 Python 代码时,可以提高代码质量和编写效率:

- autoDocstring 快速生成代码的注释,提高代码可读性与可维护性。

- autopep8,代码格式化工具。

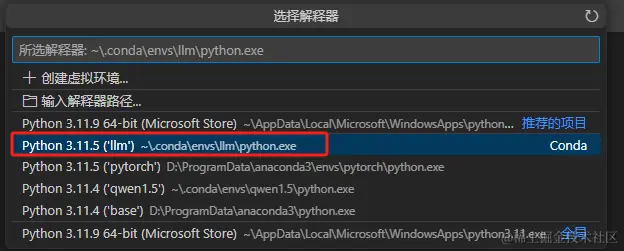

- 引入 conda 环境

首先打开引入我们的大模型目录(D:\大模型)

接着按住 Ctrl + Shift + P 打开命令面板,搜索“python 选择解析器”,选择上我们刚刚新建的 llm 环境。这样在VSCode中,我们就按照那个环境来跑我们的代码了。

尝试跑demo

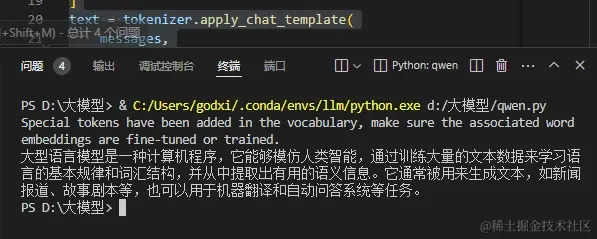

- 根据官方的指导,首先在大模型同级目录下(D:\大模型),新建一个

qwen.py文件,写入:

from transformers import AutoModelForCausalLM, AutoTokenizer device = "cuda" # the device to load the model onto # Now you do not need to add "trust_remote_code=True" model = AutoModelForCausalLM.from_pretrained( "Qwen1.5-0.5B-Chat", # 修改大模型位置 torch_dtype="auto", device_map="auto" ) tokenizer = AutoTokenizer.from_pretrained("Qwen1.5-0.5B-Chat") # 修改大模型位置 # Instead of using model.chat(), we directly use model.generate() # But you need to use tokenizer.apply_chat_template() to format your inputs as shown below # 改成中文提问 prompt = "给我简单介绍一下大型语言模型。" messages = [ {"role": "system", "content": "You are a helpful assistant."}, {"role": "user", "content": prompt} ] text = tokenizer.apply_chat_template( messages, tokenize=False, add_generation_prompt=True ) model_inputs = tokenizer([text], return_tensors="pt").to(device) # Directly use generate() and tokenizer.decode() to get the output. # Use `max_new_tokens` to control the maximum output length. generated_ids = model.generate( model_inputs.input_ids, max_new_tokens=512 ) generated_ids = [ output_ids[len(input_ids):] for input_ids, output_ids in zip(model_inputs.input_ids, generated_ids) ] response = tokenizer.batch_decode(generated_ids, skip_special_tokens=True)[0] # 打印一下助手回复的内容 print(response) 注:这里要修改对大模型的引入路径。

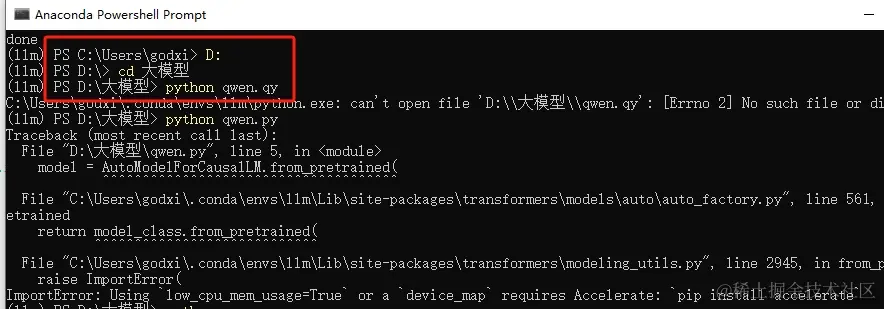

- 执行py文件:

python qwen.py

发现还是缺了一个依赖,安装:

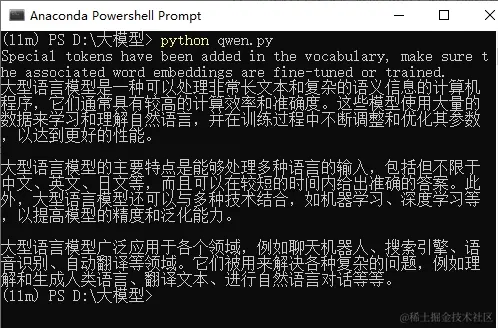

conda install conda-forge::accelerate 再重新执行,这时候就可以看到模型的回复了。

如果想在VSCode中运行,则需要选择在“在专用终端中运行 Python 文件”。

运行效果如下:

如果想要流式的,可以改为以下代码:

from transformers import AutoModelForCausalLM, AutoTokenizer, TextIteratorStreamer from threading import Thread device = "cuda" # the device to load the model onto # Now you do not need to add "trust_remote_code=True" model = AutoModelForCausalLM.from_pretrained( "Qwen1.5-0.5B-Chat", torch_dtype="auto", device_map="auto" ) tokenizer = AutoTokenizer.from_pretrained("Qwen1.5-0.5B-Chat") # Instead of using model.chat(), we directly use model.generate() # But you need to use tokenizer.apply_chat_template() to format your inputs as shown below # 改成中文提问 prompt = "给我简单介绍一下大型语言模型。" messages = [ {"role": "system", "content": "You are a helpful assistant."}, {"role": "user", "content": prompt} ] text = tokenizer.apply_chat_template( messages, tokenize=False, add_generation_prompt=True ) model_inputs = tokenizer([text], return_tensors="pt").to(device) # Directly use generate() and tokenizer.decode() to get the output. # Use `max_new_tokens` to control the maximum output length. streamer = TextIteratorStreamer( tokenizer, skip_prompt=True, skip_special_tokens=True) generation_kwargs = dict(model_inputs, streamer=streamer, max_new_tokens=512) thread = Thread(target=model.generate, kwargs=generation_kwargs) thread.start() generated_text = "" for new_text in streamer: generated_text += new_text print(generated_text) 部署为API

这时候我们借助一个 FastAPI 和 Uvicorn 来实现 API 接口的支持。

- FastAPI: 是一个用于构建 API 的现代、快速(高性能)的 web 框架,使用 Python 并基于标准的 Python 类型提示。

- Uvicorn: 是一个快速的 ASGI(Asynchronous Server Gateway Interface)服务器,用于构建异步 Web 服务。

我是参考这篇文章学习的:Python框架篇(1):FastApi-快速入门

快速启动

- 首先我们安装这两个库:

conda install fastapi uvicorn - 新建

web.py,写入代码:

import uvicorn from fastapi import FastAPI from fastapi.middleware.cors import CORSMiddleware from argparse import ArgumentParser app = FastAPI() # 支持CORS app.add_middleware( CORSMiddleware, allow_origins=['*'], allow_credentials=True, allow_methods=['*'], allow_headers=['*'], ) @app.get("/") async def index(): return {"message": "Hello World"} def _get_args(): parser = ArgumentParser() parser.add_argument('--server-port', type=int, default=8000, help='Demo server port.') parser.add_argument('--server-name', type=str, default='127.0.0.1', help='Demo server name. Default: 127.0.0.1, which is only visible from the local computer.' ' If you want other computers to access your server, use 0.0.0.0 instead.', ) args = parser.parse_args() return args if __name__ == '__main__': args = _get_args() uvicorn.run(app, host=args.server_name, port=args.server_port, workers=1) - 运行

web.py

python web.py

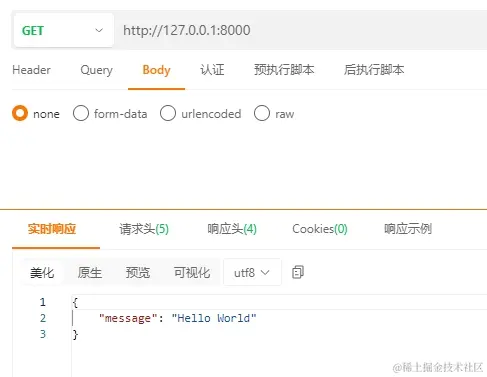

这时候请求接口,就可以看到返回 hello world :

接入大模型测试

上面已经启动API服务了,我们把前面 Qwen 的代码写进去:

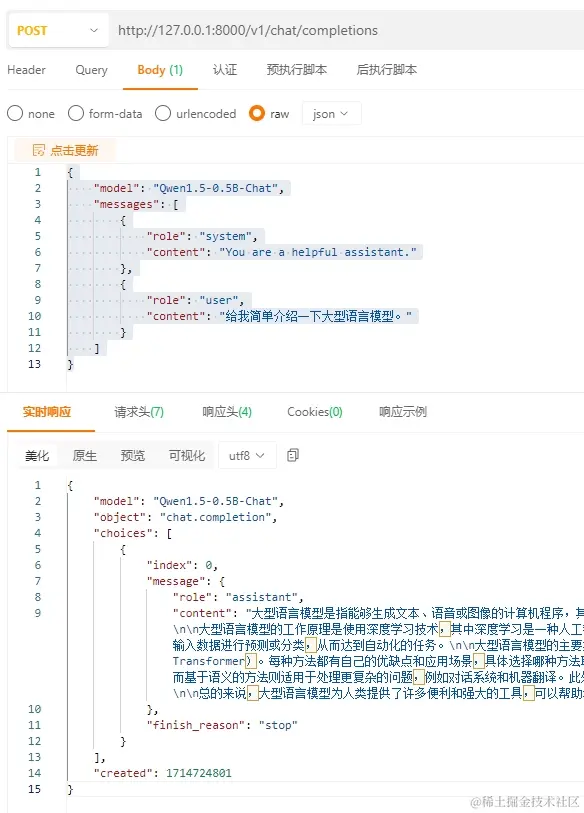

from contextlib import asynccontextmanager import torch import uvicorn import time from transformers import AutoModelForCausalLM, AutoTokenizer from fastapi import FastAPI, HTTPException from fastapi.middleware.cors import CORSMiddleware from argparse import ArgumentParser from typing import List, Literal, Optional, Union from pydantic import BaseModel, Field @asynccontextmanager async def lifespan(app: FastAPI): # collects GPU memory yield if torch.cuda.is_available(): torch.cuda.empty_cache() torch.cuda.ipc_collect() app = FastAPI(lifespan=lifespan) # 支持CORS app.add_middleware( CORSMiddleware, allow_origins=['*'], allow_credentials=True, allow_methods=['*'], allow_headers=['*'], ) class ChatMessage(BaseModel): role: Literal['user', 'assistant', 'system'] content: Optional[str] class DeltaMessage(BaseModel): role: Optional[Literal['user', 'assistant', 'system']] = None content: Optional[str] = None class ChatCompletionRequest(BaseModel): model: str messages: List[ChatMessage] stream: Optional[bool] = False class ChatCompletionResponseChoice(BaseModel): index: int message: ChatMessage finish_reason: Literal['stop', 'length'] class ChatCompletionResponseStreamChoice(BaseModel): index: int delta: DeltaMessage finish_reason: Optional[Literal['stop', 'length']] class ChatCompletionResponse(BaseModel): model: str object: Literal['chat.completion', 'chat.completion.chunk'] choices: List[Union[ChatCompletionResponseChoice, ChatCompletionResponseStreamChoice]] created: Optional[int] = Field(default_factory=lambda: int(time.time())) @app.get("/") async def index(): return {"message": "Hello World"} @app.post("/v1/chat/completions", response_model=ChatCompletionResponse) async def create_chat_completion(request: ChatCompletionRequest): global model, tokenizer # 简单的错误校验 if request.messages[-1].role != "user": raise HTTPException(status_code=400, detail="Invalid request") text = tokenizer.apply_chat_template( request.messages, tokenize=False, add_generation_prompt=True ) model_inputs = tokenizer([text], return_tensors="pt").to(model.device) # Directly use generate() and tokenizer.decode() to get the output. # Use `max_new_tokens` to control the maximum output length. generated_ids = model.generate( model_inputs.input_ids, max_new_tokens=512 ) generated_ids = [ output_ids[len(input_ids):] for input_ids, output_ids in zip(model_inputs.input_ids, generated_ids) ] response = tokenizer.batch_decode( generated_ids, skip_special_tokens=True)[0] choice_data = ChatCompletionResponseChoice( index=0, message=ChatMessage(role="assistant", content=response), finish_reason="stop" ) return ChatCompletionResponse(model=request.model, choices=[choice_data], object="chat.completion") def _get_args(): parser = ArgumentParser() parser.add_argument( '-c', '--checkpoint-path', type=str, default='Qwen1.5-0.5B-Chat', help='Checkpoint name or path, default to %(default)r', ) parser.add_argument('--server-port', type=int, default=8000, help='Demo server port.') parser.add_argument('--server-name', type=str, default='127.0.0.1', help='Demo server name. Default: 127.0.0.1, which is only visible from the local computer.' ' If you want other computers to access your server, use 0.0.0.0 instead.', ) args = parser.parse_args() return args if __name__ == '__main__': args = _get_args() # Now you do not need to add "trust_remote_code=True" model = AutoModelForCausalLM.from_pretrained( args.checkpoint_path, torch_dtype="auto", device_map="auto" ) tokenizer = AutoTokenizer.from_pretrained(args.checkpoint_path) uvicorn.run(app, host=args.server_name, port=args.server_port, workers=1) 调用下接口:

可以看到接口已经返回内容了。

增加流式支持

这里需要安装 sse_starlette 的库,来支持流式的返回:

pip install sse_starlette 安装完把代码再改一下,通过参数 stream 来判断是否流式返回:

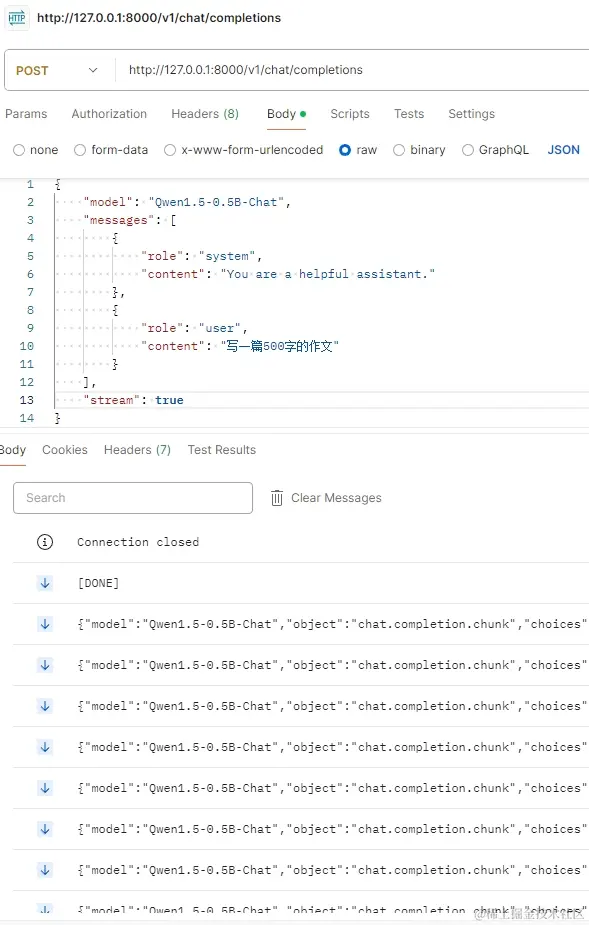

from contextlib import asynccontextmanager from threading import Thread import torch import uvicorn import time from transformers import AutoModelForCausalLM, AutoTokenizer, TextIteratorStreamer, BatchEncoding from fastapi import FastAPI, HTTPException from fastapi.middleware.cors import CORSMiddleware from argparse import ArgumentParser from typing import List, Literal, Optional, Union from pydantic import BaseModel, Field from sse_starlette.sse import EventSourceResponse @asynccontextmanager async def lifespan(app: FastAPI): # collects GPU memory yield if torch.cuda.is_available(): torch.cuda.empty_cache() torch.cuda.ipc_collect() app = FastAPI(lifespan=lifespan) # 支持CORS app.add_middleware( CORSMiddleware, allow_origins=['*'], allow_credentials=True, allow_methods=['*'], allow_headers=['*'], ) class ChatMessage(BaseModel): role: Literal['user', 'assistant', 'system'] content: Optional[str] class DeltaMessage(BaseModel): role: Optional[Literal['user', 'assistant', 'system']] = None content: Optional[str] = None class ChatCompletionRequest(BaseModel): model: str messages: List[ChatMessage] stream: Optional[bool] = False class ChatCompletionResponseChoice(BaseModel): index: int message: ChatMessage finish_reason: Literal['stop', 'length'] class ChatCompletionResponseStreamChoice(BaseModel): index: int delta: DeltaMessage finish_reason: Optional[Literal['stop', 'length']] class ChatCompletionResponse(BaseModel): model: str object: Literal['chat.completion', 'chat.completion.chunk'] choices: List[Union[ChatCompletionResponseChoice, ChatCompletionResponseStreamChoice]] created: Optional[int] = Field(default_factory=lambda: int(time.time())) @app.get("/") async def index(): return {"message": "Hello World"} @app.post("/v1/chat/completions", response_model=ChatCompletionResponse) async def create_chat_completion(request: ChatCompletionRequest): global model, tokenizer # 简单的错误校验 if request.messages[-1].role != "user": raise HTTPException(status_code=400, detail="Invalid request") text = tokenizer.apply_chat_template( request.messages, tokenize=False, add_generation_prompt=True ) model_inputs = tokenizer([text], return_tensors="pt").to(model.device) if request.stream: generate = predict(model_inputs, request.model) return EventSourceResponse(generate, media_type="text/event-stream") # Directly use generate() and tokenizer.decode() to get the output. # Use `max_new_tokens` to control the maximum output length. generated_ids = model.generate( model_inputs.input_ids, max_new_tokens=512 ) generated_ids = [ output_ids[len(input_ids):] for input_ids, output_ids in zip(model_inputs.input_ids, generated_ids) ] response = tokenizer.batch_decode( generated_ids, skip_special_tokens=True)[0] choice_data = ChatCompletionResponseChoice( index=0, message=ChatMessage(role="assistant", content=response), finish_reason="stop" ) return ChatCompletionResponse(model=request.model, choices=[choice_data], object="chat.completion") async def predict(model_inputs: BatchEncoding, model_id: str): global model, tokenizer streamer = TextIteratorStreamer( tokenizer, skip_prompt=True, skip_special_tokens=True) generation_kwargs = dict( model_inputs, streamer=streamer, max_new_tokens=512) thread = Thread(target=model.generate, kwargs=generation_kwargs) choice_data = ChatCompletionResponseStreamChoice( index=0, delta=DeltaMessage(role="assistant"), finish_reason=None ) chunk = ChatCompletionResponse(model=model_id, choices=[ choice_data], object="chat.completion.chunk") yield "{}".format(chunk.model_dump_json(exclude_unset=True)) thread.start() for new_text in streamer: choice_data = ChatCompletionResponseStreamChoice( index=0, delta=DeltaMessage(content=new_text), finish_reason=None ) chunk = ChatCompletionResponse(model=model_id, choices=[ choice_data], object="chat.completion.chunk") yield "{}".format(chunk.model_dump_json(exclude_unset=True)) choice_data = ChatCompletionResponseStreamChoice( index=0, delta=DeltaMessage(), finish_reason="stop" ) chunk = ChatCompletionResponse(model=model_id, choices=[ choice_data], object="chat.completion.chunk") yield "{}".format(chunk.model_dump_json(exclude_unset=True)) yield '[DONE]' def _get_args(): parser = ArgumentParser() parser.add_argument( '-c', '--checkpoint-path', type=str, default='Qwen1.5-0.5B-Chat', help='Checkpoint name or path, default to %(default)r', ) parser.add_argument('--server-port', type=int, default=8000, help='Demo server port.') parser.add_argument('--server-name', type=str, default='127.0.0.1', help='Demo server name. Default: 127.0.0.1, which is only visible from the local computer.' ' If you want other computers to access your server, use 0.0.0.0 instead.', ) args = parser.parse_args() return args if __name__ == '__main__': args = _get_args() # Now you do not need to add "trust_remote_code=True" model = AutoModelForCausalLM.from_pretrained( args.checkpoint_path, torch_dtype="auto", device_map="auto" ) tokenizer = AutoTokenizer.from_pretrained(args.checkpoint_path) uvicorn.run(app, host=args.server_name, port=args.server_port, workers=1) 再调用接口:

流式返回也支持了。

完善接口

接口更加完善的话可以参考 Qwen Github。

谢谢能看到最后!

大模型岗位需求

大模型时代,企业对人才的需求变了,AIGC相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

可能大家都想学习AI大模型技术,也想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把全套AI技术和大模型入门资料、操作变现玩法都打包整理好,希望能够真正帮助到大家。

-END-

如何系统的去学习大模型LLM ?

作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。

但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的 AI大模型资料 包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

😝有需要的小伙伴,可以V扫描下方二维码免费领取🆓

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

四、AI大模型商业化落地方案

阶段1:AI大模型时代的基础理解

- 目标:了解AI大模型的基本概念、发展历程和核心原理。

- 内容:

- L1.1 人工智能简述与大模型起源

- L1.2 大模型与通用人工智能

- L1.3 GPT模型的发展历程

- L1.4 模型工程

- L1.4.1 知识大模型

- L1.4.2 生产大模型

- L1.4.3 模型工程方法论

- L1.4.4 模型工程实践 - L1.5 GPT应用案例

阶段2:AI大模型API应用开发工程

- 目标:掌握AI大模型API的使用和开发,以及相关的编程技能。

- 内容:

- L2.1 API接口

- L2.1.1 OpenAI API接口

- L2.1.2 Python接口接入

- L2.1.3 BOT工具类框架

- L2.1.4 代码示例 - L2.2 Prompt框架

- L2.2.1 什么是Prompt

- L2.2.2 Prompt框架应用现状

- L2.2.3 基于GPTAS的Prompt框架

- L2.2.4 Prompt框架与Thought

- L2.2.5 Prompt框架与提示词 - L2.3 流水线工程

- L2.3.1 流水线工程的概念

- L2.3.2 流水线工程的优点

- L2.3.3 流水线工程的应用 - L2.4 总结与展望

- L2.1 API接口

阶段3:AI大模型应用架构实践

- 目标:深入理解AI大模型的应用架构,并能够进行私有化部署。

- 内容:

- L3.1 Agent模型框架

- L3.1.1 Agent模型框架的设计理念

- L3.1.2 Agent模型框架的核心组件

- L3.1.3 Agent模型框架的实现细节 - L3.2 MetaGPT

- L3.2.1 MetaGPT的基本概念

- L3.2.2 MetaGPT的工作原理

- L3.2.3 MetaGPT的应用场景 - L3.3 ChatGLM

- L3.3.1 ChatGLM的特点

- L3.3.2 ChatGLM的开发环境

- L3.3.3 ChatGLM的使用示例 - L3.4 LLAMA

- L3.4.1 LLAMA的特点

- L3.4.2 LLAMA的开发环境

- L3.4.3 LLAMA的使用示例 - L3.5 其他大模型介绍

- L3.1 Agent模型框架

阶段4:AI大模型私有化部署

- 目标:掌握多种AI大模型的私有化部署,包括多模态和特定领域模型。

- 内容:

- L4.1 模型私有化部署概述

- L4.2 模型私有化部署的关键技术

- L4.3 模型私有化部署的实施步骤

- L4.4 模型私有化部署的应用场景

学习计划:

- 阶段1:1-2个月,建立AI大模型的基础知识体系。

- 阶段2:2-3个月,专注于API应用开发能力的提升。

- 阶段3:3-4个月,深入实践AI大模型的应用架构和私有化部署。

- 阶段4:4-5个月,专注于高级模型的应用和部署。

这份完整版的大模型 LLM 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

😝有需要的小伙伴,可以Vx扫描下方二维码免费领取🆓