A Survey on Evaluation of Large Language Models

只取了鲁棒性相关的内容

LLMs:《A Survey on Evaluation of Large Language Models大型语言模型评估综述》理解智能本质(具备推理能力)、AI评估的重要性(识别当前算法的局限性+设

对抗鲁棒性是衡量大型语言模型(LLMs)在面对故意设计的、旨在误导或破坏模型性能的输入时的稳定性和安全性的关键指标。

对抗鲁棒性的定义与重要性:对抗鲁棒性关注的是LLMs在遭遇敌意提示或恶意输入时能否维持其性能和安全性。

对抗性文本攻击的评估:研究者们通过创建统一的基准测试,如PromptBench,对LLMs在不同层次上的对抗性文本攻击进行了评估,发现这些模型在面对精心设计的对抗性输入时存在脆弱性。

视觉-语言模型的鲁棒性:对于结合了视觉和语言信息的模型,研究者们评估了它们在视觉输入上的鲁棒性,并指出了视觉信息处理中的潜在风险。

OOD评估的全面概述:研究者们提供了对神经网络NLP模型的分布外(OOD)评估的全面概述,包括对抗性鲁棒性、领域泛化和数据集偏见等方面。

新的对抗性基准数据:为了更好地评估和理解LLMs的对抗鲁棒性,研究者们引入了新的基准数据集,如AdvGLUE++,这些数据集旨在通过新的评估协议来深入检查模型的伦理和安全性。

语义解析的鲁棒性研究:基于提示的语义解析任务的鲁棒性也得到了实证研究,揭示了在使用大型预训练语言模型时可能遇到的问题。

推荐系统的鲁棒性:在大型语言模型时代,推荐系统的鲁棒性问题也受到了关注,研究者们探讨了这一领域的挑战和机遇。

GLUE-X数据集:为了评估自然语言理解模型的OOD泛化能力,研究者们扩展了GLUE数据集,创建了GLUE-X,这是一个专门用于评估模型在面对分布外数据时的泛化能力的测试。

通过这些研究,我们了解到LLMs在对抗鲁棒性方面还有很大的提升空间,需要进一步的研究和技术创新来提高模型的稳定性和安全性。

下面是原出处:

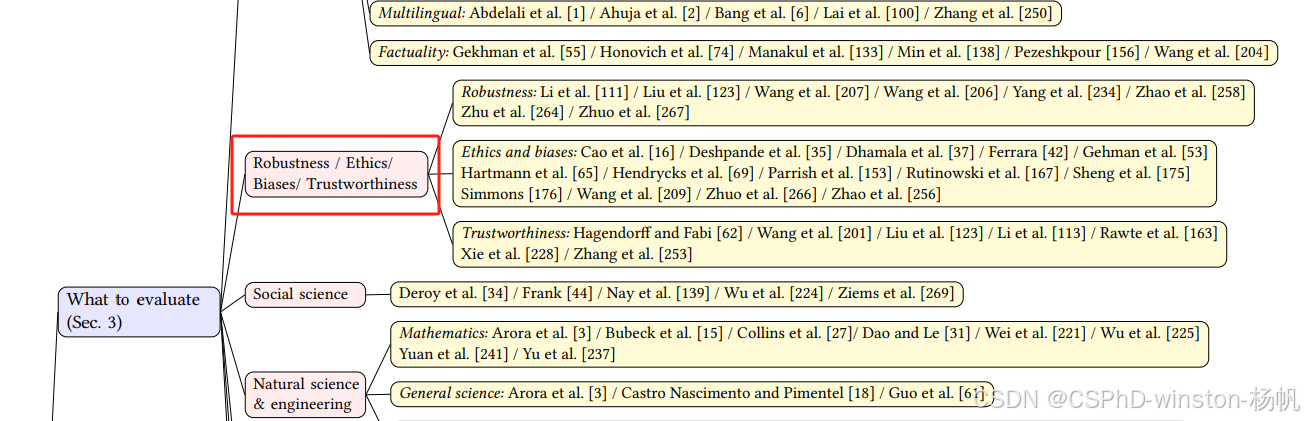

3.2.1 Robustness鲁棒性:两方面考察(分布外泛化OOD+对抗鲁棒性)、评估ChatGPT(AdvGLUE+ANLI+DDXPlus+AdvGLUE++,PromptBench基准)、两方面脆弱(语言输入的对抗性提示+视觉输入)

评估系统面对意外输入的稳定性是鲁棒性研究的核心,主要从对抗鲁棒性和出分布泛化两方面考察大语言模型,发现当前模型对对抗性提示和视觉输入显著脆弱,提示模型在部署中面临安全隐患,需要继续提高模型的鲁棒性。

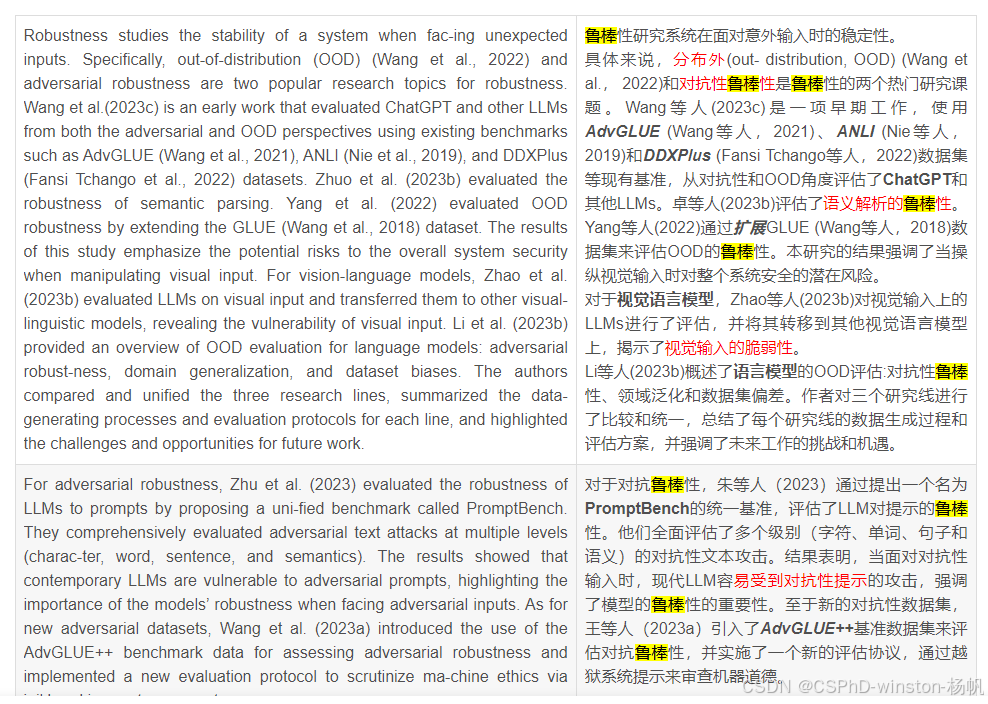

鲁棒性研究系统在面对意外输入时的稳定性。

具体来说,分布外(out- distribution, OOD) (Wang et al., 2022)和对抗性鲁棒性是鲁棒性的两个热门研究课题。Wang等人(2023c)是一项早期工作,使用AdvGLUE (Wang等人,2021)、ANLI (Nie等人,2019)和DDXPlus (Fansi Tchango等人,2022)数据集等现有基准,从对抗性和OOD角度评估了ChatGPT和其他LLMs。卓等人(2023b)评估了语义解析的鲁棒性。Yang等人(2022)通过扩展GLUE (Wang等人,2018)数据集来评估OOD的鲁棒性。本研究的结果强调了当操纵视觉输入时对整个系统安全的潜在风险。

对于视觉语言模型,Zhao等人(2023b)对视觉输入上的LLMs进行了评估,并将其转移到其他视觉语言模型上,揭示了视觉输入的脆弱性。

Li等人(2023b)概述了语言模型的OOD评估:对抗性鲁棒性、领域泛化和数据集偏差。作者对三个研究线进行了比较和统一,总结了每个研究线的数据生成过程和评估方案,并强调了未来工作的挑战和机遇。

对于对抗鲁棒性,朱等人(2023)通过提出一个名为PromptBench的统一基准,评估了LLM对提示的鲁棒性。他们全面评估了多个级别(字符、单词、句子和语义)的对抗性文本攻击。结果表明,当面对对抗性输入时,现代LLM容易受到对抗性提示的攻击,强调了模型的鲁棒性的重要性。至于新的对抗性数据集,王等人(2023a)引入了AdvGLUE++基准数据集来评估对抗鲁棒性,并实施了一个新的评估协议,通过越狱系统提示来审查机器道德。