阅读量:0

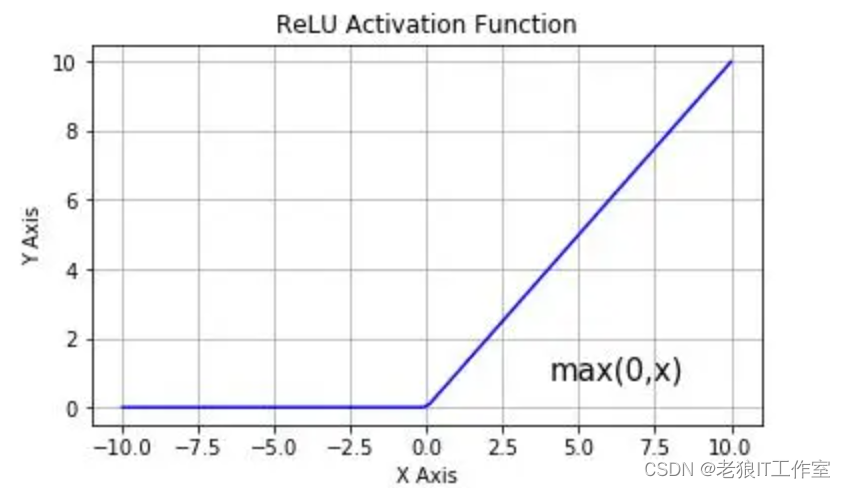

ReLU激活函数介绍

ReLU(Rectified Linear Unit)是一种常用的激活函数,全称为修正线性单元。它的主要作用是将输入值限制在一个非负的范围内,即当输入值小于0时,输出值为0;当输入值大于等于0时,输出值等于输入值本身。ReLU函数的表达式为:f(x) = max(0, x)。

ReLU函数的优点是计算简单,梯度不会消失,适用于处理非线性问题。同时,ReLU函数的导数也很容易计算,这使得它在深度学习中得到了广泛的应用。

ReLU激活函数使用场景

ReLU激活函数使用场景,如下:

- 神经网络中的隐藏层和输出层,因为ReLU函数可以解决梯度消失问题,使得神经网络更容易训练。

- 卷积神经网络中的卷积层和池化层,因为ReLU函数可以提取图像的特征。

- 循环神经网络(RNN)和长短时记忆网络(LSTM),因为ReLU函数可以解决梯度消失问题,使得RNN和LSTM更容易训练。

- 自编码器和生成对抗网络(GAN),因为ReLU函数可以提高模型的训练速度和性能。

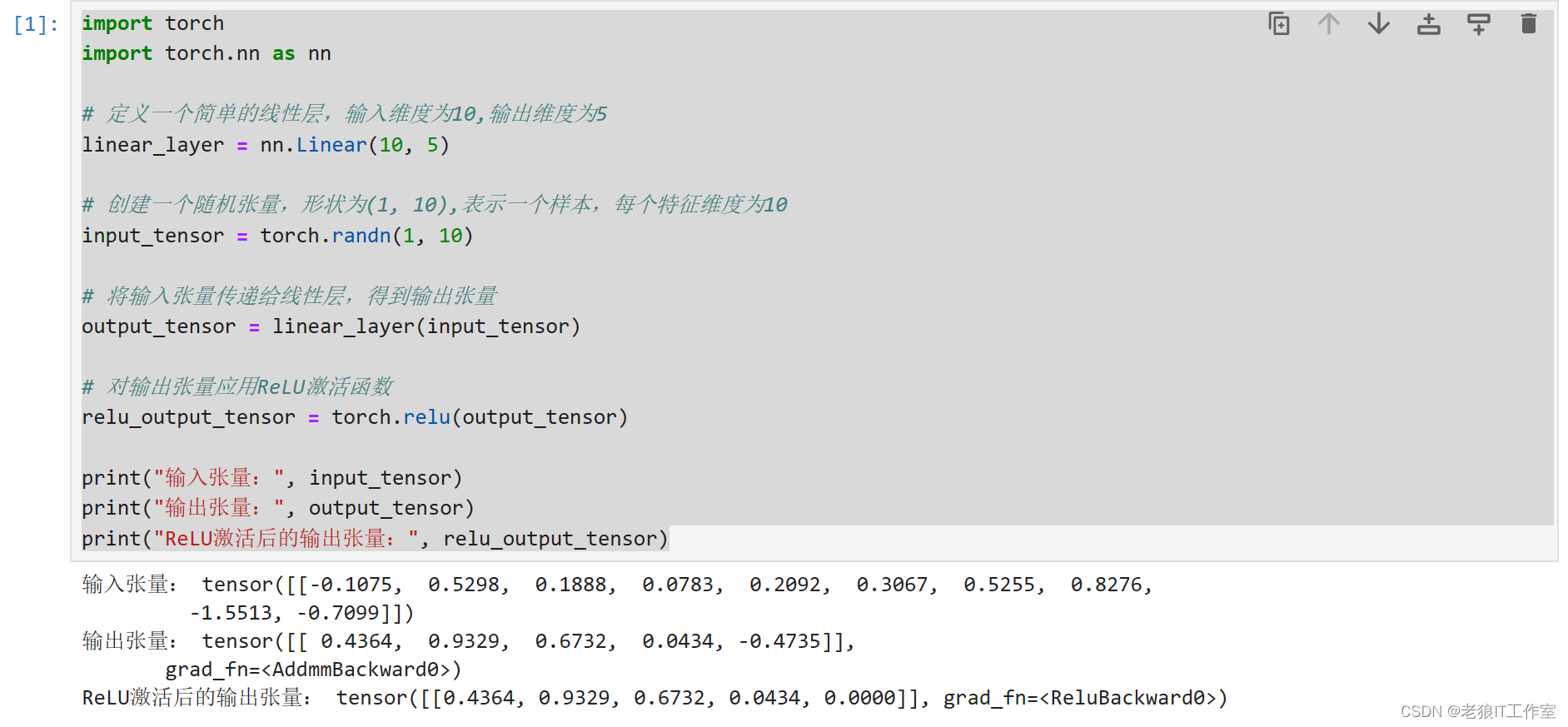

ReLU激活函数使用案例

import torch import torch.nn as nn # 定义一个简单的线性层,输入维度为10,输出维度为5 linear_layer = nn.Linear(10, 5) # 创建一个随机张量,形状为(1, 10),表示一个样本,每个特征维度为10 input_tensor = torch.randn(1, 10) # 将输入张量传递给线性层,得到输出张量 output_tensor = linear_layer(input_tensor) # 对输出张量应用ReLU激活函数 relu_output_tensor = torch.relu(output_tensor) print("输入张量:", input_tensor) print("输出张量:", output_tensor) print("ReLU激活后的输出张量:", relu_output_tensor)

在这个示例中,我们首先导入了PyTorch库,并定义了一个简单的线性层。然后,我们创建了一个随机张量作为输入,将其传递给线性层,得到输出张量。最后,我们对输出张量应用了ReLU激活函数,得到了ReLU激活后的输出张量。