一、集群情况介绍

我的本地虚拟机,一共有三个节点,hadoop102、hadoop103、hadoop104

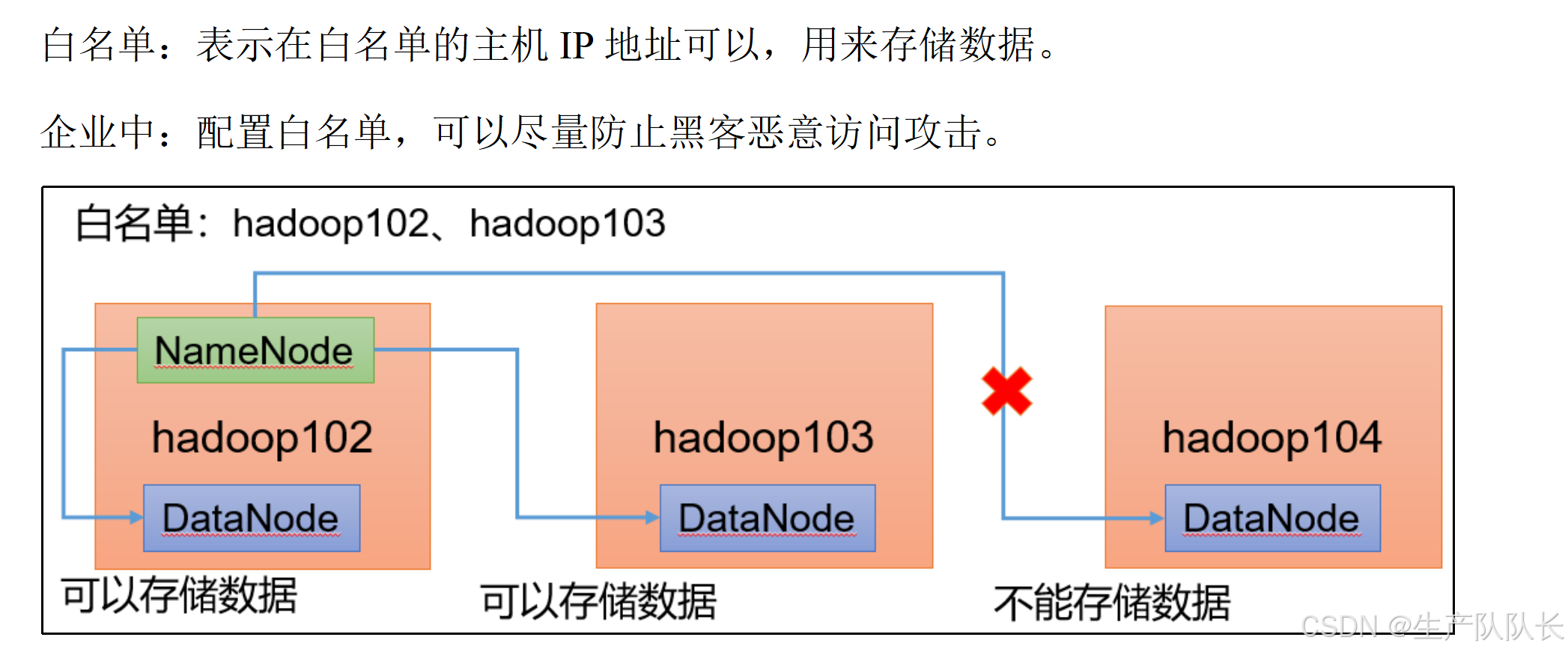

二、白名单

创建白名单文件whitelist,通过白名单的配置,只允许集群包含102和103两台机器可以存储数据,104无法存储数据。

需求

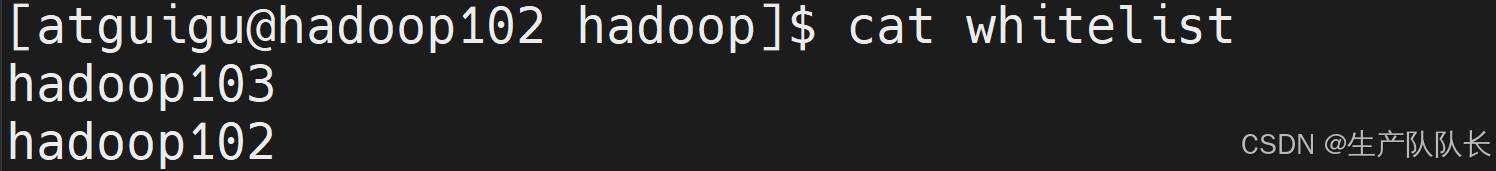

1、创建白名单

这个位置是任意选择的,因为,hadoop配置文件都在这里,所以我就放这个下面了。 cd /opt/module/hadoop-3.1.3/etc/hadoop vim whitelist

2、HDFS关联白名单

在hdfs-site.xml配置文件中增加dfs.hosts配置参数

<!-- 白名单 --> <property> <name>dfs.hosts</name> <value>/opt/module/hadoop-3.1.3/etc/hadoop/whitelist</value> </property> 3、分发配置文件

xsync whitelist hdfs-site.xml 4、重启集群

第一次配置白明单,需要重启集群。

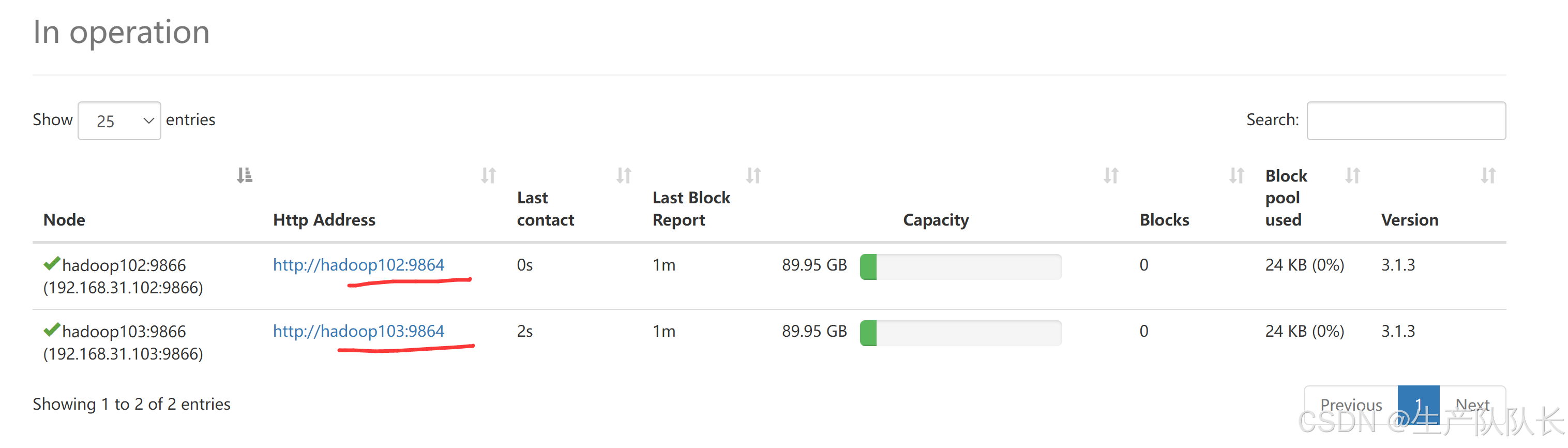

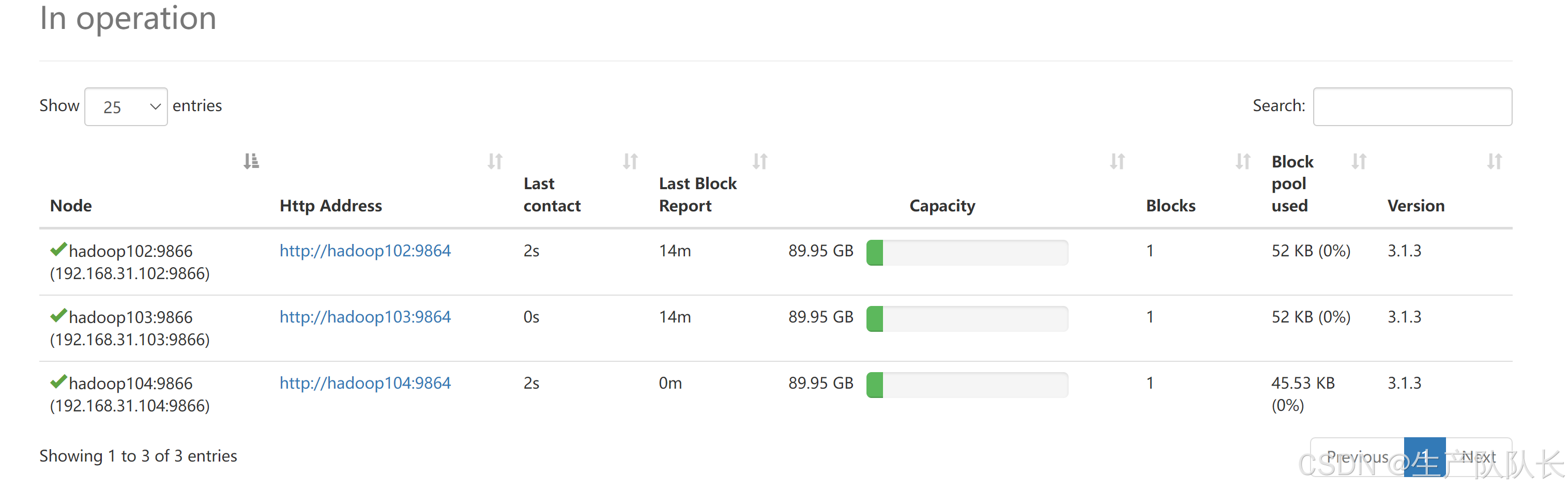

myhadoop stop myhadoop start 5、查看页面

发现只有102和103节点

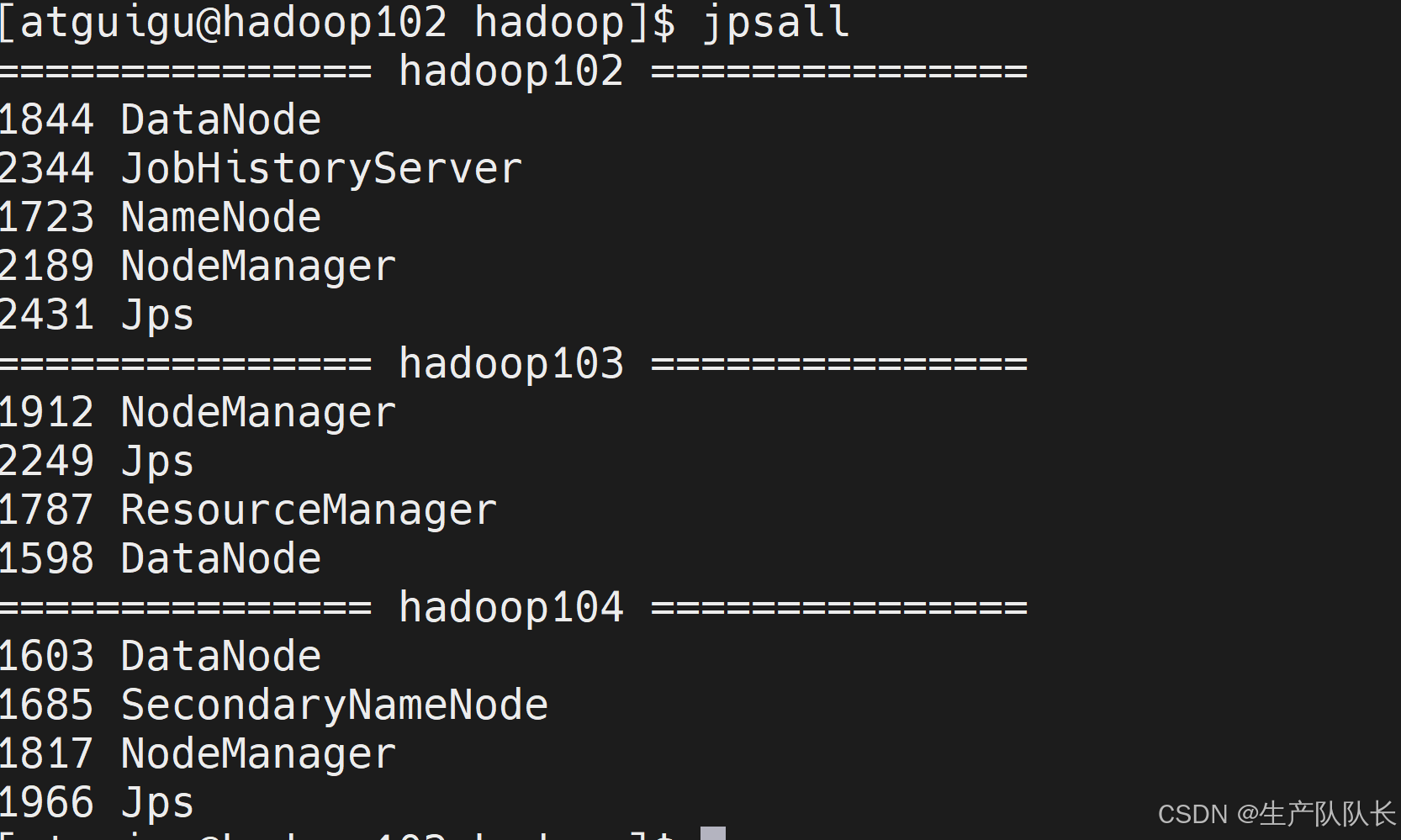

6、查看进程状态

发现104正常启动的

7、从104上传文件

cd /opt/module/hadoop-3.1.3/ hadoop fs -put NOTICE.txt / 可以正常上传

查看页面

只有102和103有数据块,并且副本数依然是3个。

8、重新配置104到白名单

分发文件

xsync whitelist 刷新节点,无需重启

hdfs dfsadmin -refreshNodes

查看页面

节点添加成功,且104也自动增加一份副本数据。

9、结论

通过上述实验,我们证明了,104被排除出集群了,可以上传文件,只是104的客户端功能。

但是,104无法存储数据块了。

实现了预期效果。

且,再次修改白名单,无需重启集群。

三、动态扩容

集群运行状态下,进行服务器节点的增加扩容。

新节点的初始化配置

添加新节点到集群

1、添加新节点到白名单文件

cd /opt/module/hadoop-3.1.3/etc/hadoop vim whitelist xsync whitelist

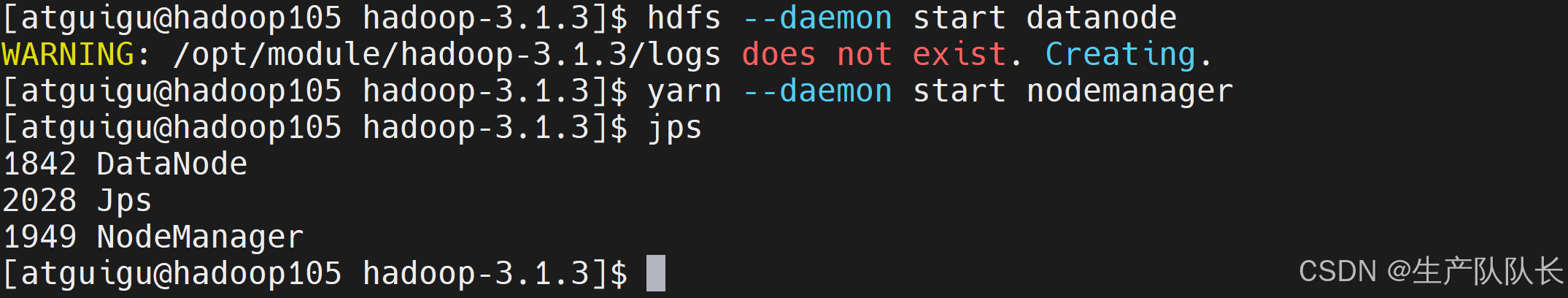

2、单点启动新节点的Hadoop

hdfs --daemon start datanode yarn --daemon start nodemanager

3、刷新集群白名单配置

hdfs dfsadmin -refreshNodes

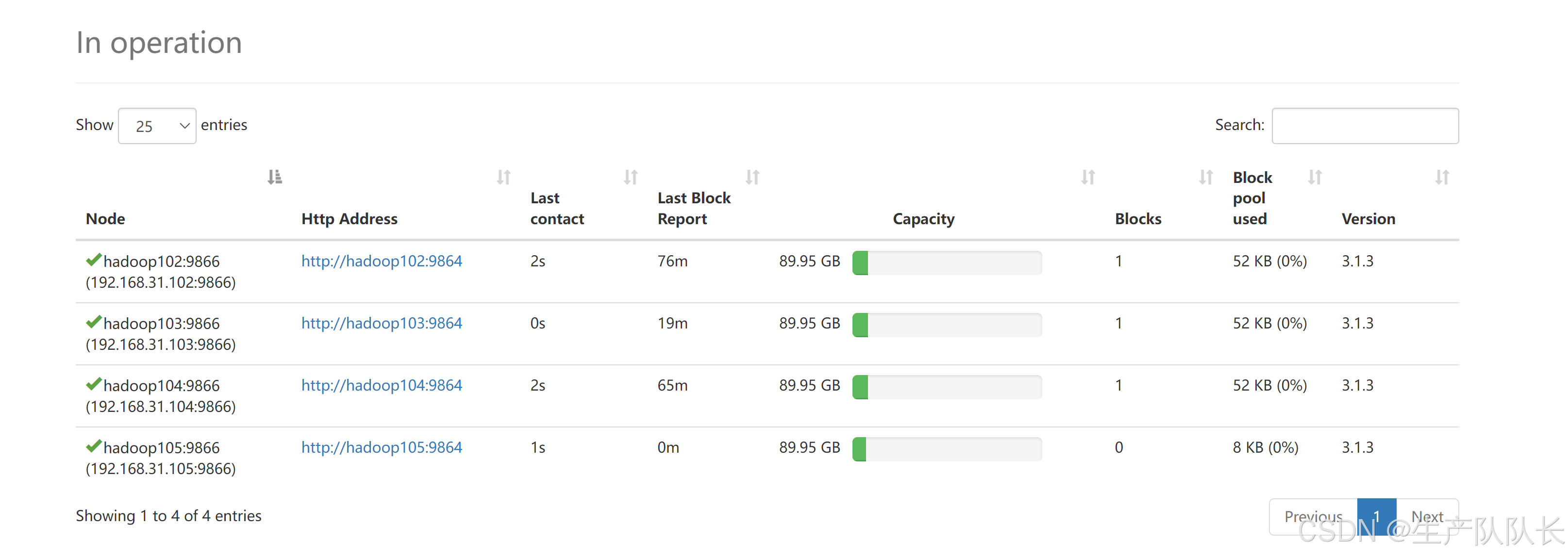

4、新节点测试

上传一个文件到集群

hadoop fs -put wc.jar /

发现,无需重启集群,我们就给集群新增了一个节点,并能正常使用。

5、集群数据均衡

一般,我们新增一个节点之后,这个节点是没有数据的。

所以,我们需要进行一次数据均衡操作,这样,才能让新增的节点分担集群压力。

cd /opt/module/hadoop-3.1.3/ sbin/start-balancer.sh -threshold 10 sbin/stop-balancer.sh 命令解释sbin/start-balancer.sh -threshold 10

对于参数10,代表的是集群中各个节点的磁盘空间利用率相差不超过10%,可根据实际情况进行调整。

sbin/stop-balancer.sh

停止均衡操作

注意:由于HDFS需要启动单独的Rebalance Server来执行Rebalance操作

所以尽量不要在NameNode上执行start-balancer.sh,而是找一台比较空闲的机器。

四、黑名单配置实现退役服务器

1、说明

黑名单:表示在黑名单的主机IP地址不可以,用来存储数据。

企业中:配置黑名单,用来退役服务器。

通过定义可以知道,黑名单的IP必定在白名单中。否则,没意义。

2、配置黑名单

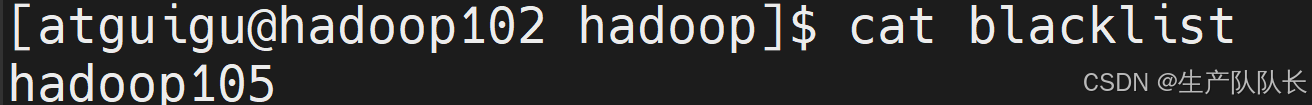

cd /opt/module/hadoop-3.1.3/etc/hadoop vim blacklist

3、HDFS关联黑名单

在hdfs-site.xml配置文件中增加dfs.hosts配置参数

<!-- 白名单 --> <property> <name>dfs.hosts</name> <value>/opt/module/hadoop-3.1.3/etc/hadoop/blacklist</value> </property> 4、分发配置

xsync blacklist hdfs-site.xml 5、刷新集群配置

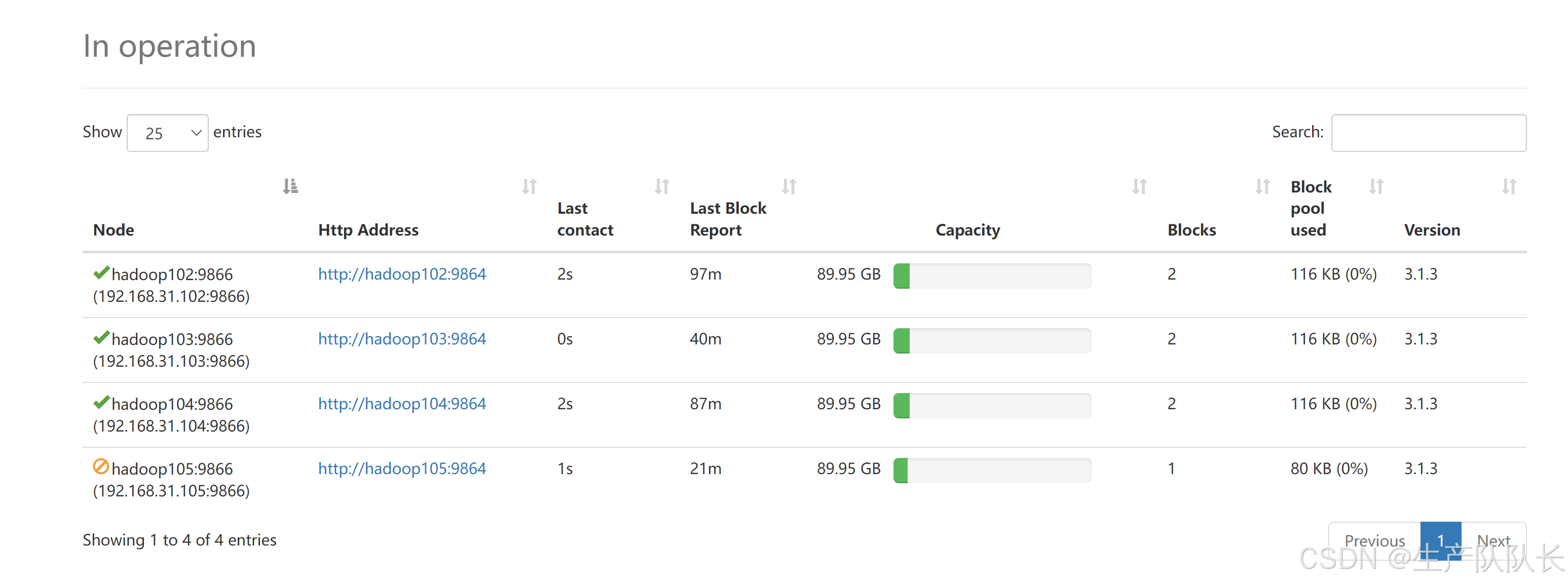

hdfs dfsadmin -refreshNodes 6、查看网页

正在退役105服务器

因为105有数据,所以,需要一段时间

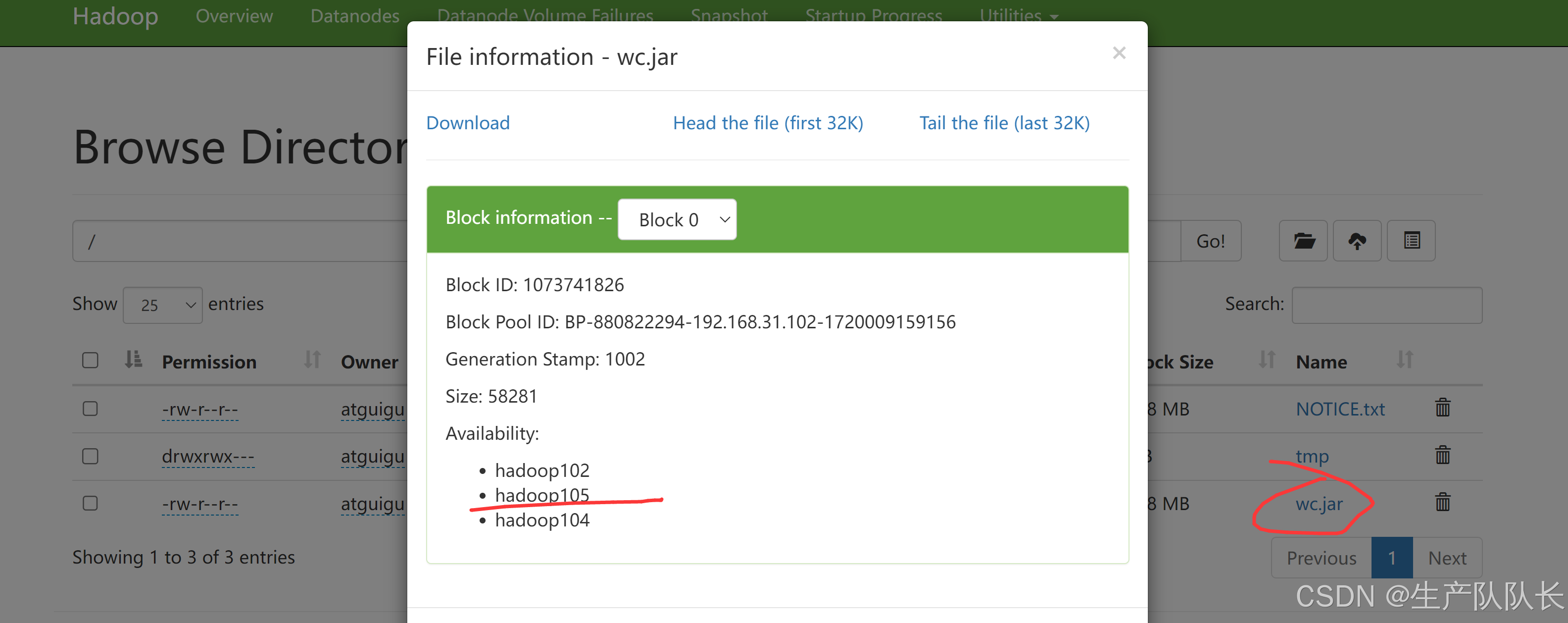

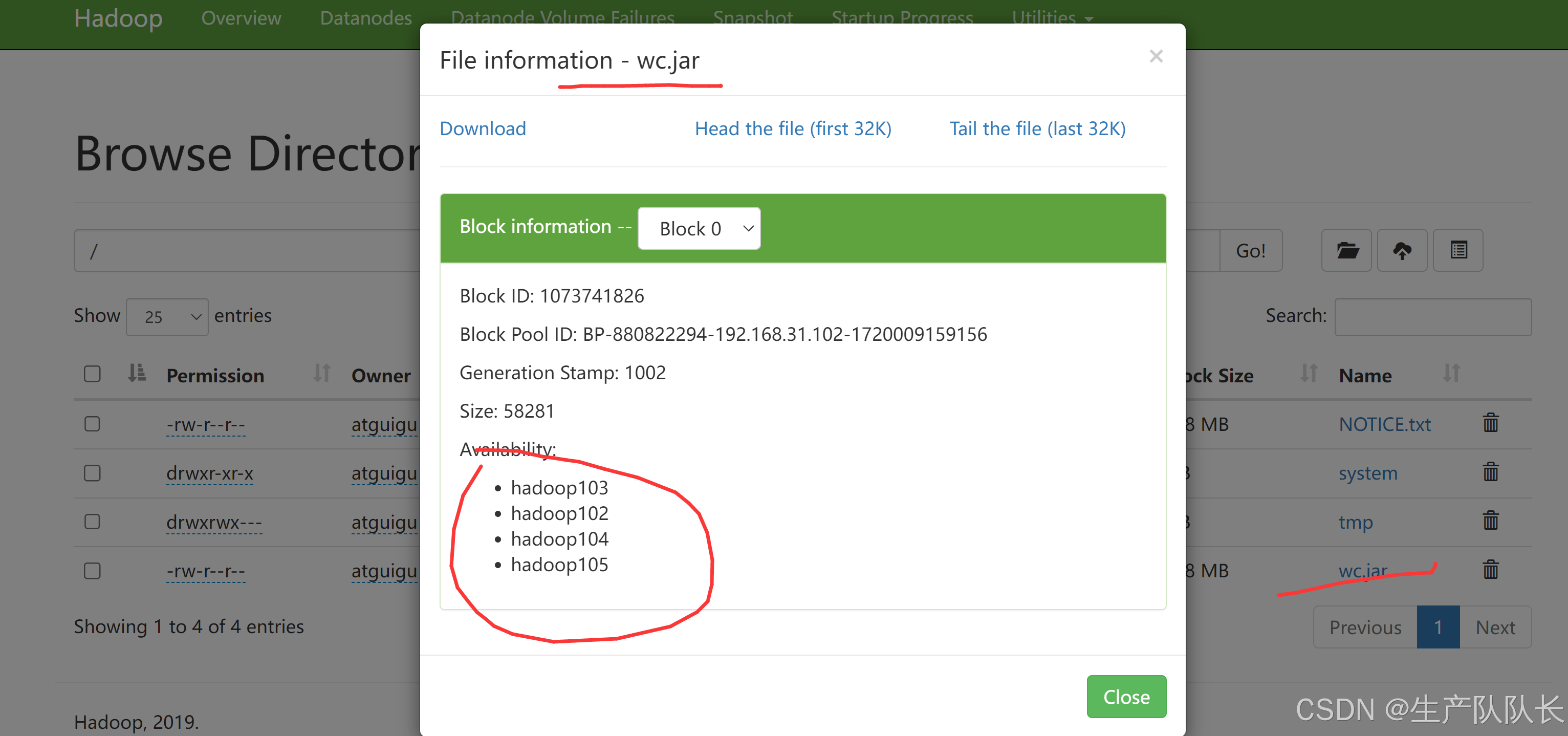

数据同步完成后的状态

wc.jar的副本多了一个103,说明,105的副本拷贝到103上了。

6、停止105的Hadoop服务

hdfs --daemon stop datanode yarn --daemon stop nodemanager 需要到10分钟30秒后,才会从页面清除节点信息。

7、数据均衡

一般,退役一个节点,也要进行一次数据均衡

sbin/start-balancer.sh -threshold 10